BlogPerspectivas del sector

¿Burbuja de la IA o ciclo de adopción? Una guía para fundadores

Konstantin BuzzLíder de investigación

Lectura de 5 min

La visión de un realista cauto: donde la especulación termina y comienza el ROI repetible, y cómo juzgar su preparación para la inteligencia híbrida.

Hay un verdadero frenesí en torno a la IA en este momento. Todos intentan subirse a la ola, y sí, existe una burbuja. La mentalidad de la fiebre del oro invita al abuso y a los atajos. La pregunta no es si existe la espuma, sino qué sobrevive después de que explota: ¿es esta otra burbuja puntocom? ¿O es una moderna manía de los tulipanes, que podría sacudir aún más la economía y la cultura empresarial, si no las normas públicas?

Una nueva historia de advertencia: Deloitte acordó reembolsar parcialmente al gobierno de Australia después de que se descubriera que un informe de 440.000 AUD contenía citas fabricadas y otros errores. La firma reconoció posteriormente que se utilizaron herramientas de GenAI (Azure OpenAI / GPT-4o) en la redacción. Un buen recordatorio de que, sin una validación adecuada y controles con intervención humana, las herramientas “inteligentes” se convierten en riesgos para la marca.

El greenwashing ha dado paso al AI washing – afirmaciones exageradas o engañosas sobre el uso de la IA. Los reguladores están tratando de cercarlo: la SEC de EE. UU. ya ha presentado casos por afirmaciones falsas sobre IA y violaciones de marketing.

Paralelamente, el gasto empresarial sigue aumentando: IDC espera que el gasto global en IA alcance aproximadamente los 632.000 millones de dólares para 2028. Esto no son publicaciones de exageración, son partidas presupuestarias.

La escala es difícil de ignorar. En los últimos meses, los informes han valorado a OpenAI en casi medio billón de dólares, y los informes también apuntan a asociaciones a escala de billones con empresas de la nube y chips. Esto incluye planes de centros de datos de 10 gigavatios, compromisos de nube a varios años, y un rumoreado programa "Stargate" que suena más a un proyecto energético que a una actualización de TI. Contraste eso con los ingresos actuales (órdenes de magnitud menores) y obtendrá la disonancia que hace que la gente grite "burbuja".

Y sin embargo, no es solo aire. Una cohorte líder de empresas “AI-first” ya está registrando un ARR significativo. Los ingresos de OpenAI a mediados de 2025 son reales (miles de millones, no millones). Las startups más jóvenes están alcanzando los umbrales de ingresos iniciales más rápido de lo que lo hizo el SaaS clásico. Bajo el capó, las curvas de capacidad-precio siguen evolucionando: el mismo presupuesto compra más producción cada pocos meses, incluso si la latencia y los recargos por contexto largo complican la situación. Por eso los compradores serios siguen gastando; la economía unitaria mejora a medida que se instrumenta el trabajo. Sin embargo, las expectativas y los gastos de capital superan claramente la cuenta de resultados actual.

Ambas tribus admiten el sobrecalentamiento. Constructores e inversores usan la palabra “burbuja” sin inmutarse. MarketWatch estima que es “17 veces el tamaño de la burbuja puntocom”. Otros argumentan que muchas burbujas industriales dejaron atrás una infraestructura útil. Los reguladores añaden una nota de sobriedad, advirtiendo que el entusiasmo puede superar los fundamentos y retroceder rápidamente.

Y sin embargo, ¿dónde se encontrará un valor duradero?

El valor duradero no proviene de las demostraciones. Una regla simple se mantiene después de cada ciclo de exageración: si un flujo de trabajo deja evidencia, ahorra tiempo medible y puede ser reproducido, sobrevive. Si no se puede medir o auditar, era marketing. Tres patrones parecen estar destinados a perdurar.

Flujos de trabajo agénticos.

Los agentes harán el trabajo preliminar (recopilar, transformar, proponer) y luego se detendrán para una decisión humana donde reside el riesgo. Fundamentalmente, dejan un rastro que se puede volver a ejecutar: entradas, pasos, salidas y aprobaciones. Y cuando los agentes están conectados a los sistemas que mueven una empresa (tareas, emisión de tickets, comunicaciones, CRMs), su producción se convierte en un cambio de estado, no en otro chat. Esos son los agentes por los que los mercados siguen pagando.

RAG sobre datos privados.

Los modelos que perduren mostrarán su trabajo. La generación aumentada por recuperación (RAG) permite que un sistema responda a partir de fuentes aprobadas y las cite. En la práctica, esto significa una biblioteca de documentos limpia y propia, reglas de acceso claras y actualizaciones rutinarias para que el material se mantenga al día. Combine eso con comprobaciones regulares de precisión y barandillas simples —una explicación de dónde provino una respuesta y qué no puede hacer el modelo— y obtendrá algo que tanto a inversores como a reguladores les gusta: respuestas verificables y repetibles.

Orquestación y telemetría.

Los ganadores se parecerán menos a chatbots y más a servicios que se pueden ejecutar. Eso significa rastreos de extremo a extremo, costo y latencia por respuesta, avisos y políticas versionadas, y alguien claramente responsable cuando las cosas fallan, respaldado por paneles, alertas y análisis post-mortem. Agregue enrutamiento inteligente y almacenamiento en caché para que las preguntas fáciles utilicen modelos más baratos y las respuestas comunes no se vuelvan a calcular. Cuando lleguen las facturas, solo los sistemas instrumentados pasarán el corte.

Las interfaces importarán, pero no de la manera que prometen las presentaciones. La voz es útil hoy para la captura y el trabajo manos libres, pero sigue siendo más lenta y desordenada que la entrada estructurada: una opción, no una columna vertebral.

Una perspectiva a tres años

2025–2026: la exageración se desinfla.

La era de los envoltorios pierde fuerza. Las aplicaciones similares que invocan un modelo de frontera más un par de herramientas se desvanecen a medida que los compradores preguntan si los resultados cambian de estado en los sistemas centrales. Los envoltorios delgados dan paso a productos con orquestación, gestión de datos y rastros de evidencia.

La avalancha de API/AgentKit continúa: más productos expondrán formas sencillas para que los agentes actúen ((API – la puerta de entrada de un producto; kit de agente – herramientas iniciales para que los agentes lo usen; cuando está en mayúscula – la marca de OpenAI)). Pero los beneficiarios cambian: para 2026, los ganadores se parecerán menos a chats y más a servicios con una columna vertebral. La autocorrección se convierte en estándar: los avisos recursivos y los patrones multiagente se extienden, con modelos que critican sus propias salidas o las verifican de forma cruzada mediante herramientas, lo que aumenta la fiabilidad sin ralentizar a los humanos.

La inferencia sigue siendo cada vez más barata en promedio, pero de forma desigual entre las tareas; el contexto largo y el tiempo real siguen siendo caros. Dos cambios prácticos se hacen sentir:

— El borde se ilumina: un aumento de los casos de uso de IoT y robótica ligera (inspección, recogida y embalaje, instalaciones) que ejecutan rutinas simples de circuito cerrado.

— Gravedad del protocolo: los equipos se cansan del pegamento a medida; surgen estándares de interacción sobre cómo los modelos invocan herramientas, pasan el estado y entregan el control a los humanos.

Algunas marcas tropiezan; los turistas se van. Los supervivientes ejecutan pipelines instrumentados con un retorno de la inversión medible. Surgen pods de entrega de agentes de IA en alcances estrechos, que establecen flujos de trabajo de extremo a extremo (preparación de datos → borrador → revisión → archivo) bajo supervisión humana, útiles donde las reglas son estrictas y la varianza es baja. Los inversores rotan hacia la mejora de la eficiencia compuesta: optimizadores, programadores, cuantificación/destilación y compresión de memoria que producen pequeñas pero fiables ganancias en costos/latencia.

2026–2027: la curva S lenta.

Las pilas se asientan; la historia pasa de las demostraciones a la utilidad aburrida, muy parecido a DevOps + la nube en la década de 2010, cuando la experimentación dio paso a pipelines, SLA y paneles de control de costos. Las empresas construyen bibliotecas internas de herramientas/conocimientos; las adquisiciones solicitan tarjetas de evaluación, procedencia y planes neutrales respecto al proveedor. La consolidación de protocolos se acelera: formas comunes de describir tareas, credenciales y reglas de seguridad permiten que los agentes se conecten a CRMs, ERPs y sistemas de planta sin trabajo a medida. El capital favorece a los equipos que mueven métricas en el margen (tiempo de decisión, $/respuesta, éxito@K (porcentaje de resultados correctos en el top-K)) y demuestran que pueden escalar.

Para 2028: el cambio de infraestructura.

La estructura del mercado se bifurca:

— Concentración de primer nivel: un puñado de empresas de IA de primer rango forman superconglomerados en torno a la computación, los datos y (en algunos casos) la cuántica, poseyendo las capas de capital más pesadas.

— Ganadores viables de medianas/pequeñas empresas: especialistas en IA con implementaciones disciplinadas y sin errores en flujos de trabajo concretos, donde la evidencia, la repetibilidad y la economía unitaria son obvias. Los compradores prefieren sistemas que muestren la auditabilidad a primera vista; en sectores sensibles, las huellas soberanas/locales se convierten en requisitos rutinarios.

La IA se retira a la plataforma, una opción como el almacenamiento o las colas, no un proyecto. Los presupuestos fluyen hacia las operaciones y el control: SLAs, telemetría, respuesta a incidentes, aplicación de políticas.

Riesgos clave: qué podría sacar a una empresa del mercado

1) Fallos de confianza (los asesinos rápidos).

Confiar excesivamente en los modelos, verificar insuficientemente los resultados y el “AI washing” erosionan rápidamente la credibilidad. Un error público o una afirmación engañosa pueden cerrar puertas con clientes y reguladores. Mitigación: puntos de control humanos en acciones de riesgo, evidencia/citaciones por defecto, divulgaciones en lenguaje sencillo.

2) Exposición y seguridad de los datos.

Fugas de contexto a través de registros, cachés o inyección de prompts; uniones de API descuidadas; retención poco clara. Una sola brecha puede ser existencial. Mitigación: acceso con privilegios mínimos, aislamiento de contexto, red-teaming, higiene de secretos, políticas claras de retención.

3) Colapso de la economía unitaria.

Los costos invisibles de observabilidad, evaluaciones y reelaboración se disparan; los casos de uso de contexto largo y en tiempo real disparan el gasto; la latencia no cumple con los SLA. Mitigación: costo/latencia por respuesta en paneles, enrutamiento y caché de modelos, contextos limitados, interruptores de emergencia para trabajos descontrolados.

4) Dependencia y fragilidad del proveedor.

La dependencia excesiva de un solo modelo/proveedor lo deja expuesto a interrupciones, cambios de política o cambios de precios. Mitigación: abstracción multimodo, avisos/evaluaciones exportables, cláusulas de salida de contratos.

5) Cumplimiento y responsabilidad.

Reglas del sector (PII (información de identificación personal), propiedad intelectual, auditabilidad) más la atención del regulador a las afirmaciones engañosas. Mitigación: flujos de datos mapeados, rastros de auditoría, evaluaciones documentadas, aprobación legal del lenguaje de marketing.

6) Cuellos de botella estructurales.

La energía, los chips y el suministro de datos limpios pueden limitar el crecimiento o dejar varados los gastos de capital a medida que las generaciones tecnológicas cambian. Mitigación: planes de capacidad por fases, gestión de datos y umbrales conservadores de ROI en grandes construcciones.

Hacia la inteligencia híbrida

Está sucediendo, con o sin nuestro permiso. Las máquinas asumirán mucho más trabajo –órdenes de magnitud más– de lo que ya lo han hecho. Eso no significa un enfrentamiento hombre contra máquina en un horizonte a medio plazo realista. Significa que nuestras decisiones, proyectos y servicios serán producidos cada vez más por híbridos: personas, modelos y sistemas de datos trabajando como un solo tejido.

Piense en la inteligencia híbrida como una nube de cognición compartida. Los algoritmos aportan velocidad y recuerdo; los humanos añaden juicio, valores y contexto; los sistemas corporativos proporcionan los registros; los gobiernos establecen las reglas, tardíamente. Las organizaciones que permanezcan conectadas a este tejido —donde la inteligencia híbrida pueda leer las fuentes correctas, actuar en los sistemas adecuados y mostrar su trabajo— simplemente se moverán más rápido y cometerán menos errores evitables. También esperamos que los sistemas de IA agéntica ejecuten el ciclo completo de investigación y desarrollo científico —desde la propuesta de hipótesis y el diseño de experimentos hasta la ejecución de análisis y la redacción de informes— mientras un investigador principal humano los dirige hacia las preguntas correctas.

La inteligencia híbrida es una división del trabajo. Aquellos que permanezcan desconectados se sentirán lentos, como una mula en una autopista: mayor tiempo de decisión, viajes de cliente más débiles, operaciones frágiles. La forma que perdura después de la burbuja es simple: dejar que los modelos hagan lo que mejor saben hacer, mantener a los humanos donde el juicio importa y conectar a ambos a través de sistemas que preserven la evidencia.

En un futuro previsible, las interfaces engrosarán el tejido. Los dispositivos ponibles y el audio ambiental convertirán las reuniones y el trabajo de campo en un contexto utilizable; las indicaciones ligeras se alojarán dentro de las herramientas donde ya se realiza el trabajo. En el horizonte, las interfaces neuronales podrían abrir un enlace de gran ancho de banda entre los sistemas de IA y la intención humana.

La última milla: cómo prepararse y cómo se ve ya lo “híbrido”

Trabajen juntos, desde el principio.

Comiencen formando equipos mixtos: humanos y agentes en el mismo ciclo. Pídanle a la IA que investigue, y luego que se autocorriga y al equipo. Enseñen a las personas a colaborar con la IA, a aprender de ella y a enseñarle de nuevo (operaciones en pareja, playbooks).

Manténgase alerta a modelos, reglas y precios.

Siga las principales actualizaciones de modelos y los movimientos regulatorios (normas locales de privacidad y del sector). Mantenga un ojo en los precios para no gastar de más en tokens y contexto. Hábito simple: un informe mensual de una página con “lo que cambió”, las diferencias de costos y el impacto en sus flujos de trabajo.

Practique la higiene de datos.

Inventaríe y apruebe sus fuentes. Decida cuáles son ‘oro’, quién las mantiene y con qué frecuencia se actualizan. Elimine o enmascare la PII (información de identificación personal). Establezca reglas de retención. Controle las cachés y las capas temporales para que el contexto sensible no se filtre en los registros.

Inserte el factor humano en los puntos de decisión.

Defina los puntos de control, los roles y los protocolos de escalada para los pasos de alto riesgo. Haga que las aprobaciones formen parte del artefacto (quién firmó, cuándo, con qué evidencia).

Audite el acceso y añada telemetría.

Si no puede verlo, no puede escalarlo. Conozca el flujo de trabajo. Descubra quién puede leer/escribir qué fuentes, qué se está registrando y quién lo aprobó. Implemente rastreos de extremo a extremo. Realice un seguimiento de las versiones de los modelos, el consumo de tokens y la latencia por respuesta.

Elija su huella: en la nube o soberana.

Cuando la política o los contratos con clientes lo requieran, planifique implementaciones locales. De lo contrario, sea explícito sobre por qué la nube es aceptable y cómo saldrá si es necesario.

Pruebe la colaboración híbrida

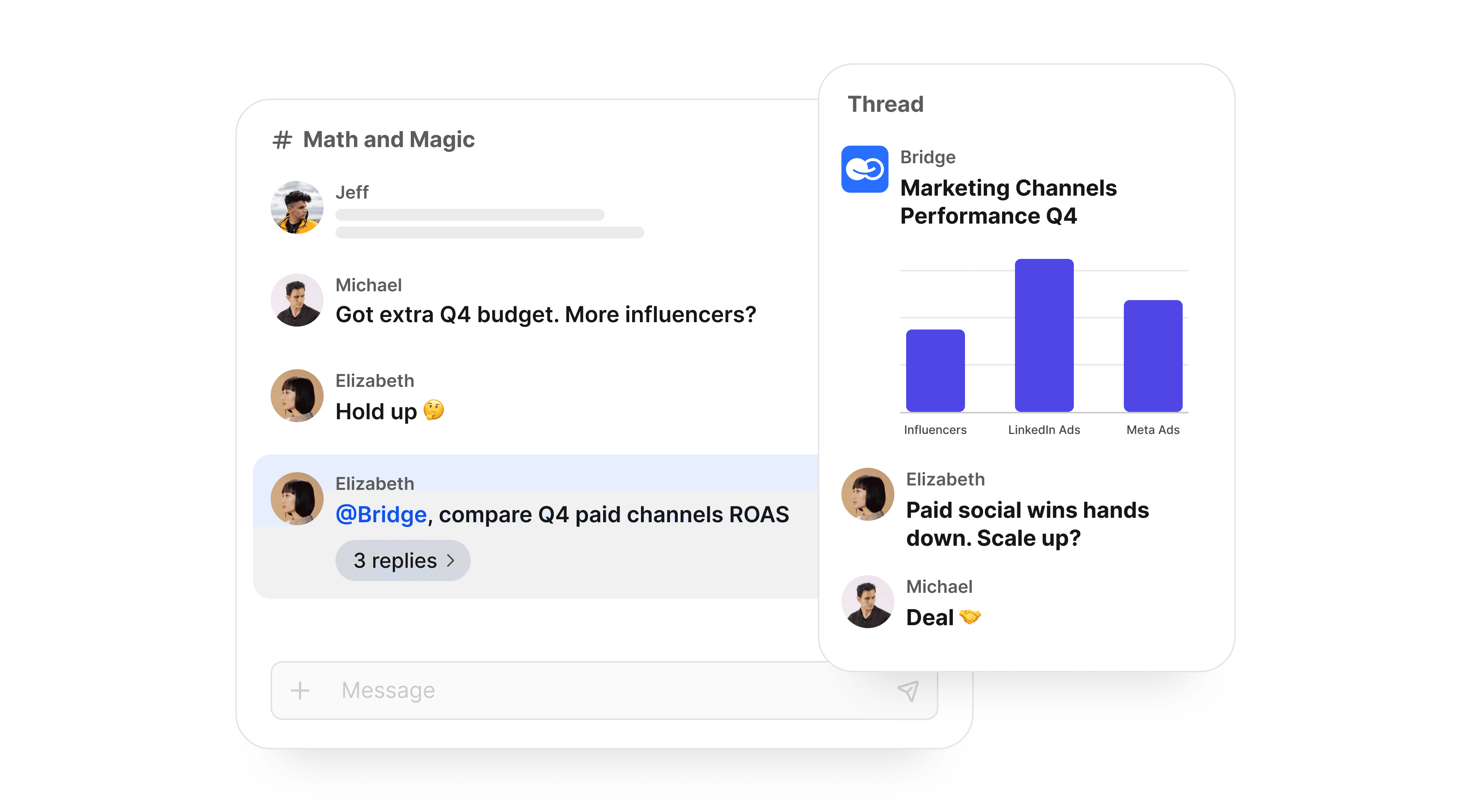

El cambio ya es visible en herramientas que conviven con el trabajo, no fuera de él. Un patrón típico:

- Los flujos agénticos extraen información de conocimientos aprobados, redactan un plan y se detienen en los puntos de control de interacción humana (HITL) para su juicio.

- El RAG sobre datos privados basa las respuestas en citas de sus documentos, tickets y registros.

- La orquestación y la telemetría rastrean cada paso, con el costo/latencia por respuesta en un panel de control y prompts/políticas versionadas para auditoría.

- La integración de sistemas significa que el resultado no es una transcripción, sino un ticket archivado, un registro actualizado, un flujo de trabajo avanzado.

Estos principios ya dan forma a una nueva clase de plataformas colaborativas.

BridgeApp es una de ellas. Los agentes allí no chatean por diversión: la IA gestiona tareas rutinarias, las decisiones se toman más rápido, las transferencias son menos frecuentes y la lógica es observable. Puede mostrar los resultados a auditores, clientes y a su propio equipo.

Vea cómo BridgeApp puede impulsar cambios de estado reales en su negocio.