BlogPerspectivas del sector

Guía Completa del Protocolo de Contexto del Modelo (MCP): Arquitectura, Integración y Mejores Prácticas

Equipo BridgeApp

Lectura de 7 min

¿Qué es MCP (Protocolo de Contexto del Modelo)?

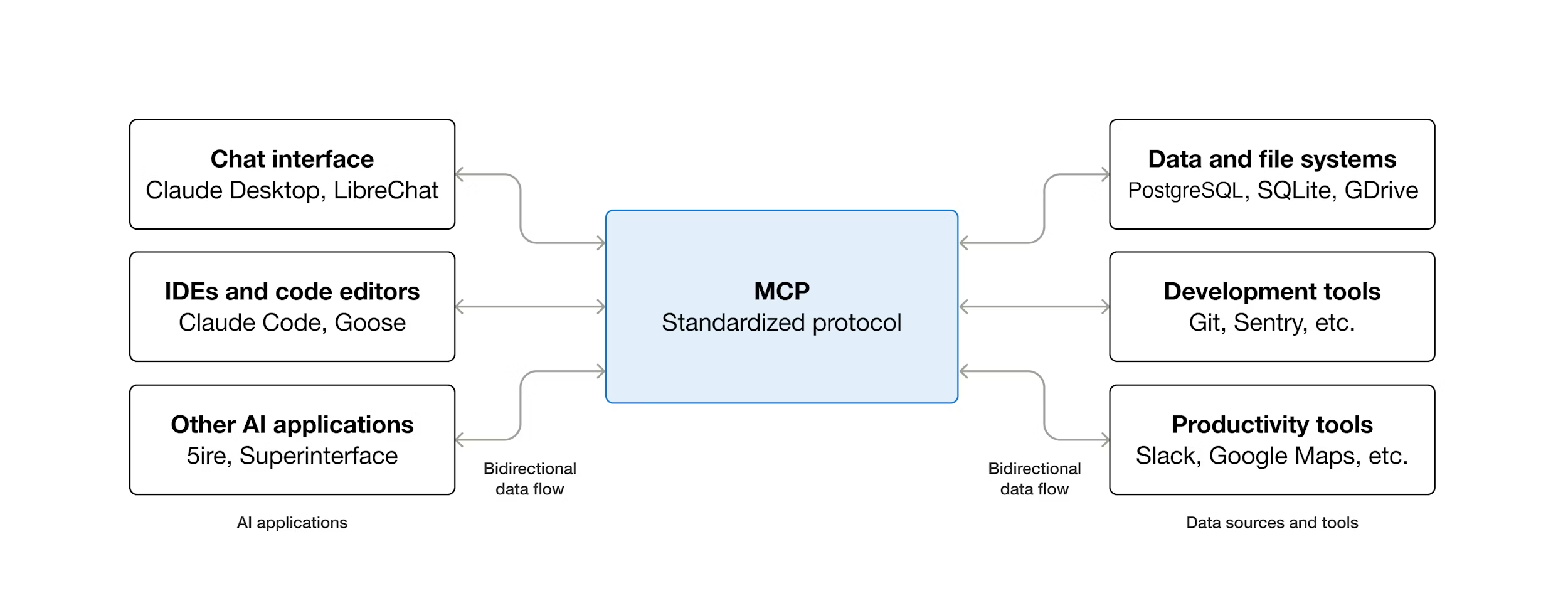

El Protocolo de Contexto del Modelo (MCP) es un estándar abierto introducido por Anthropic en noviembre de 2024 que define cómo los modelos de IA se conectan de forma segura con herramientas externas, bases de datos y servicios.

Piense en MCP como el **USB-C de las integraciones de IA**: un estándar universal que permite a cualquier aplicación de IA conectarse a cualquier fuente de datos o herramienta, sin adaptadores personalizados para cada par.

Los grandes modelos de lenguaje (LLM) son muy capaces de razonar y generar texto, pero tienen una limitación fundamental: no pueden acceder a datos del mundo real ni invocar herramientas externas por sí solos. MCP fue diseñado para resolver exactamente este problema.

A diferencia de un simple envoltorio de API, un servidor MCP hace mucho más que traducir llamadas HTTP. Gestiona el estado de la sesión, aplica el control de acceso, expone un menú estructurado de capacidades y garantiza que los modelos de IA reciban información precisa, oportuna y contextualmente relevante.

**Definición rápida:** MCP es un protocolo cliente-servidor construido sobre JSON-RPC 2.0 que permite a las aplicaciones de IA descubrir y llamar herramientas y fuentes de datos externas a través de una interfaz única y estandarizada.

Arquitectura y Componentes de MCP

En su núcleo, MCP define una arquitectura cliente-servidor construida sobre JSON-RPC 2.0, un estándar abierto y ligero para llamadas a procedimientos remotos.

Este diseño resuelve el clásico **problema N×M**: conectar N modelos de IA diferentes a M fuentes de datos diferentes sin escribir N×M adaptadores personalizados.

La arquitectura MCP consta de cuatro componentes principales:

- Host MCP

- Cliente MCP

- Servidor MCP

- Capa de Transporte

Capa de Transporte

Los servidores MCP pueden comunicarse:

- **Localmente a través de stdio** — para implementaciones en la misma máquina

- **Remotamente a través de HTTP (HTTP Transmisible)** — para sistemas distribuidos

Las conexiones remotas requieren HTTPS con autenticación adecuada. Las conexiones locales son adecuadas para entornos de desarrollo o implementaciones estrictamente controladas.

Host MCP

El host MCP es el entorno de aplicación de nivel superior donde opera un asistente de IA. Los ejemplos incluyen:

- IDEs

- Interfaces de chat

- Frameworks de agentes autónomos

El host es responsable de:

- Descubrir los servidores MCP disponibles

- Orquestar las solicitudes a esos servidores

- Mostrar solicitudes de permiso para operaciones sensibles

Al inicio de la sesión, el host realiza un handshake de descubrimiento para aprender qué herramientas, recursos y prompts están disponibles. Para acciones riesgosas (por ejemplo, escribir en un sistema de archivos), el host impone la confirmación y supervisión humana.

Cliente MCP

El cliente MCP reside dentro del host y mantiene una conexión uno a uno con un único servidor MCP.

Sus responsabilidades incluyen:

- Traducir la intención de alto nivel en solicitudes JSON-RPC

- Registrar las capacidades del servidor

- Normalizar y retransmitir las respuestas al host

Al inicio de la sesión, el cliente realiza el **registro de capacidades**, consultando al servidor los métodos disponibles y almacenándolos en caché para su uso en tiempo de inferencia.

SDKs Soportados

Los SDK oficiales están disponibles para:

- Python

- TypeScript

- Java

- Kotlin

- C#

Ejemplo: Inicialización de un cliente MCP en Python

from mcp import ClientSession, StdioServerParameters

from mcp.client.stdio import stdio_client

server_params = StdioServerParameters(

command="python",

args=["my_mcp_server.py"]

)

async with stdio_client(server_params) as (read, write):

async with ClientSession(read, write) as session:

await session.initialize()

tools = await session.list_tools()

print(tools)

Servidor MCP

El servidor MCP es el servicio externo que proporciona datos, contexto o capacidades al LLM. Se sitúa entre el modelo de IA y los sistemas subyacentes como:

- Bases de datos

- APIs

- Plataformas SaaS

- Sistemas de archivos

Capacidades Clave Expuestas por los Servidores MCP

- **Herramientas** — acciones ejecutables (ej. consultas SQL, incidencias de GitHub)

- **Recursos** — datos de solo lectura (esquemas, archivos, artículos de la base de conocimientos)

- **Prompts** — plantillas de instrucciones predefinidas

Ejemplo: Definición de una herramienta en un servidor MCP

from mcp.server import Server

from mcp.server.models import InitializationOptions

import mcp.types as types

server = Server("my-server")

@server.list_tools()

async def list_tools() -> list[types.Tool]:

return [

types.Tool(

name="get_sales_summary",

description="Fetch last month's sales data from the database",

inputSchema={

"type": "object",

"properties": {

"month": {

"type": "string",

"description": "Month in YYYY-MM format"

}

},

"required": ["month"]

}

)

]

MCP vs API vs Llamada a Funciones

| Característica | API Tradicional | Llamada a Funciones | MCP |

|---|---|---|---|

| Estandarización | Personalizada por servicio | Específica del modelo | Universal |

| Descubrimiento | Documentación manual | Esquema estático | Tiempo de ejecución |

| Soporte multi-herramienta | Personalizado por N×M | Limitado | Integrado |

| Sesión/estado | Lado de la aplicación | Ninguno | Lado del servidor |

| Estándar abierto | No | No | Sí |

| Dependencia del proveedor | Alta | Media | Baja |

**Distinción clave:**

La llamada a funciones invoca una función dentro de una aplicación. MCP permite a cualquier aplicación de IA compatible con MCP descubrir y llamar a cualquier servidor MCP dinámicamente en tiempo de ejecución.

Control de Acceso y Seguridad

La seguridad es fundamental en las implementaciones de MCP.

Las mejores prácticas incluyen:

- HTTPS para servidores remotos

- Claves API, tokens u OAuth para autenticación

- Permisos acotados por método de herramienta (privilegio mínimo)

Para operaciones riesgosas (escrituras, eliminaciones, mensajes salientes), los servidores MCP deben requerir solicitudes explícitas de permiso, asegurando la supervisión humana incluso en flujos de trabajo automatizados.

MCP dentro de BridgeApp: Transformando su Espacio de Trabajo en un Sistema Agente

Con el soporte nativo de MCP, BridgeApp se convierte en un entorno totalmente interoperable donde los agentes de IA, las herramientas y los datos operan dentro de una única capa de contexto. Ahora es posible integrar cualquiera de sus herramientas a través de MCP para construir flujos de trabajo complejos impulsados por nuestro motor de IA. Conecte sus herramientas existentes una vez. A partir de ese momento, nosotros nos encargamos de los flujos de trabajo complejos y de múltiples pasos que solían consumir el tiempo de su equipo: enrutamiento de solicitudes, actualización de registros, activación de acciones en todos los sistemas y mantenimiento de la sincronización de cada departamento, automáticamente.

¿Cómo se conecta un servidor MCP externo en BridgeApp?

**La respuesta corta: está en Agentes → Servidores MCP, y toma unos dos minutos.**

La respuesta más larga comienza con lo que realmente sucede cuando se conecta. Pega la URL del servidor MCP —normalmente se encuentra en la documentación del proveedor—, elige el tipo de autenticación que requiere el servidor, y BridgeApp hace el resto. Obtiene automáticamente todos los métodos disponibles de ese servidor y los lista con descripciones. Ve exactamente lo que la integración puede hacer antes de construir algo con ella.

Las opciones de autenticación cubren las configuraciones más comunes: sin autenticación, código de autorización, credenciales de cliente, token de espacio de trabajo, token de usuario o código de autenticación de espacio de trabajo, según lo que admita su proveedor.

Para concretar: conectamos Ahrefs para nuestro equipo de marketing. Creamos un agente de análisis. Le dimos acceso al MCP de Ahrefs. El agente ahora extrae datos de búsqueda en tiempo real y responde a preguntas de SEO directamente dentro de BridgeApp, en el mismo chat donde ocurre el resto del trabajo.

Integraciones MCP con Sistemas y Agentes de IA

MCP permite a los agentes de IA:

- Leer archivos

- Consultar bases de datos

- Llamar a APIs externas

- Escribir resultados de vuelta a los sistemas de origen

Todo dentro de un único flujo de trabajo, sin código de integración personalizado.

Los clientes MCP comunes incluyen:

- Asistentes de codificación

- Frameworks de agentes autónomos

- Chatbots empresariales

- Pipelines RAG

Flujo Típico de Integración de Agentes

- Registrar las capacidades del servidor MCP

- Proporcionar metadatos ricos para cada herramienta

- Invocar herramientas a través del cliente MCP durante la inferencia

Mejores metadatos mejoran la fiabilidad en la selección de herramientas.

Llamada a Funciones e IA Agente

MCP formaliza y extiende la llamada a funciones al exponer herramientas a través de una interfaz unificada y descubrible.

Esto permite un verdadero comportamiento de agente:

- Leer la intención del usuario

- Seleccionar herramientas

- Ejecutar acciones

- Decidir los siguientes pasos de forma autónoma

MCP también soporta la **elicitación** — solicitando entradas faltantes antes de la ejecución — y mantiene la memoria de sesión a través de múltiples llamadas a herramientas.

Patrones de Integración de MCP

Servidores de Bases de Datos

Exponga métodos de consulta seguros y parametrizados en lugar de SQL puro.

Servidores de Sistemas de Archivos

Proporcione acceso de lectura/escritura con ámbito utilizando directorios raíz.

Integraciones SaaS

Gestiona la autenticación, la limitación de velocidad y la normalización de datos internamente mientras expone una interfaz limpia al modelo de IA.

Mejores Prácticas para Servidores MCP

- Documentación clara de JSON Schema

- Códigos de error estructurados

- Validación estricta de entradas

- Limitación de velocidad

- Componibilidad dinámica y diseño modular

Estas prácticas permiten que los servidores MCP escalen en sistemas complejos y multi-agente.

Fuentes de Datos y Datos Externos

Cada fuente de datos debe registrarse con:

- Un esquema de respuesta claro

- Salidas validadas

- Acceso con ámbito (por ejemplo, directorios raíz del sistema de archivos)

Esto reduce las alucinaciones y aplica el principio de mínimo privilegio.

Observabilidad y Monitorización

Seguimiento:

- Percentiles de latencia por herramienta

- Tasas de error

- Sesiones activas y aciertos de caché

- Rendimiento bajo carga

El rastreo de extremo a extremo es fundamental para depurar el comportamiento de los agentes.

Despliegue: Servidores MCP Locales vs Remotos

Despliegue Local

Lo mejor para herramientas de desarrollador y entornos controlados.

Despliegue Remoto

Lo mejor para sistemas empresariales y plataformas multiusuario.

Consideraciones de producción:

- Autoescalado

- Caché

- Tolerancia a fallos y redundancia

Preguntas Frecuentes: Protocolo de Contexto del Modelo

¿Qué es el Protocolo de Contexto del Modelo (MCP) en términos sencillos?

El Protocolo de Contexto del Modelo (MCP) es una forma abierta y estandarizada para que los modelos y agentes de IA interactúen de forma segura con herramientas externas, bases de datos, APIs y servicios.

En términos sencillos, MCP actúa como un **puente universal entre la IA y el mundo real**. En lugar de codificar integraciones para cada herramienta, MCP permite que las aplicaciones de IA descubran, entiendan y utilicen dinámicamente capacidades externas a través de un único protocolo. Esto hace que los sistemas de IA sean más flexibles, escalables y fiables.

¿Quién creó MCP y por qué se introdujo?

MCP fue introducido por **Anthropic en noviembre de 2024** como un estándar abierto.

La motivación detrás de MCP fue resolver un problema creciente en la ingeniería de IA: los sistemas de IA modernos necesitan acceso a datos y herramientas en tiempo real, pero los enfoques existentes (APIs personalizadas y llamada a funciones) no escalan bien. MCP fue diseñado para:

- Reducir la complejidad de la integración

- Eliminar la dependencia del proveedor

- Habilitar flujos de trabajo de IA de agente seguros

- Estandarizar la comunicación de IA a herramienta

Aunque creado por Anthropic, MCP **no es propietario** y está destinado a una amplia adopción en la industria.

¿Es MCP de código abierto y neutral respecto al proveedor?

Sí. MCP es tanto de **código abierto** como **neutral respecto al proveedor**.

- La especificación del protocolo es pública

- Las implementaciones de referencia son mantenidas por la comunidad

- Cualquier empresa o individuo puede implementar servidores o clientes MCP

Esta apertura es crítica para evitar la fragmentación del ecosistema y garantizar que MCP pueda ser utilizado en diferentes modelos de IA, frameworks y proveedores de infraestructura.

¿En qué se diferencia MCP de una API tradicional?

Una API tradicional requiere que los desarrolladores escriban código de integración personalizado para cada cliente y cada caso de uso. Esto conduce rápidamente a sistemas frágiles y a un esfuerzo duplicado.

MCP difiere de varias maneras clave:

- **Descubrimiento dinámico**: los modelos de IA pueden descubrir herramientas en tiempo de ejecución

- **Interfaz estandarizada**: sin adaptadores personalizados por integración

- **Contexto gestionado por el servidor**: el estado y los permisos se gestionan de forma centralizada

- **Diseño centrado en la IA**: los esquemas y metadatos están optimizados para el razonamiento de LLM

En resumen, las APIs se construyen para humanos y aplicaciones. MCP se construye **para sistemas de IA**.

¿Cuál es la diferencia entre MCP y la llamada a funciones de LLM?

La llamada a funciones permite a un LLM invocar funciones predefinidas dentro de una única aplicación. Estas funciones suelen estar codificadas de forma rígida y estrechamente acopladas a la aplicación.

MCP va mucho más allá:

- Las herramientas son expuestas por **servidores externos**, no incrustadas en la aplicación

- Las capacidades se descubren **dinámicamente** en tiempo de ejecución

- MCP funciona con diferentes proveedores, lenguajes y plataformas

- El estado de la sesión y los permisos se gestionan en el servidor

La llamada a funciones es una característica. MCP es un **protocolo a nivel de ecosistema**.

¿Puede MCP funcionar con cualquier modelo de IA o LLM?

Sí. MCP es **independiente del modelo**.

- Funciona con:

- Claude

- Modelos GPT

- Gemini

- LLM de código abierto

- Cualquier modelo que soporte el uso de herramientas o salida estructurada

MCP no depende de una arquitectura de modelo específica. Siempre que un sistema de IA pueda interpretar esquemas de herramientas y producir llamadas estructuradas, puede usar MCP.

¿Qué problemas resuelve MCP para los agentes de IA?

MCP permite a los agentes de IA ir más allá de la generación de texto estática y convertirse en **sistemas capaces de actuar**.

Problemas clave que resuelve MCP:

- Acceso seguro a datos en tiempo real

- Invocación fiable de herramientas

- Memoria de sesión persistente

- Ejecución de acciones con permisos

- Orquestación escalable de múltiples herramientas

Esto hace que MCP sea fundamental para la **IA de agente**, donde los sistemas planifican, actúan, observan resultados e iteran de forma autónoma.

¿Qué son las herramientas, recursos y prompts de MCP?

Los servidores MCP exponen tres tipos principales de capacidades:

- **Herramientas**: Acciones ejecutables (ej. consultas a bases de datos, escrituras de archivos, llamadas a API)

- **Recursos**: Fuentes de datos de solo lectura (archivos, esquemas, documentos)

- **Prompts**: Plantillas de instrucciones predefinidas para un comportamiento consistente del modelo

Esta separación mejora la seguridad, la claridad y la calidad del razonamiento para los LLM.

¿Cómo gestiona MCP la seguridad y el control de acceso?

La seguridad es un principio fundamental del diseño de MCP.

Las mejores prácticas incluyen:

- HTTPS para servidores MCP remotos

- Claves API, tokens o autenticación OAuth

- Permisos granulares por método de herramienta

- Aprobación explícita del usuario para operaciones de riesgo

MCP sigue un **modelo de mínimo privilegio**, asegurando que los sistemas de IA solo accedan a lo que se les permite explícitamente usar.

¿Puede MCP mantener el contexto y la memoria entre sesiones?

Sí. Los servidores MCP pueden mantener **el estado y la memoria a nivel de sesión**.

Esto permite:

- Flujos de trabajo de múltiples pasos

- Tareas de agente de larga duración

- Persistencia del contexto a través de múltiples llamadas a herramientas

La gestión de la sesión se maneja en el lado del servidor, haciendo que los agentes de IA sean más fiables y menos frágiles.

¿Cómo reduce MCP las alucinaciones en los sistemas de IA?

MCP reduce las alucinaciones mediante:

- Imponiendo esquemas estructurados para entradas y salidas

- Proporcionando contratos explícitos de herramientas y datos

- Validando las respuestas antes de devolverlas al modelo

- Limitando el acceso a recursos bien definidos

Al restringir lo que el modelo puede ver y hacer, MCP mejora la fundamentación fáctica y la fiabilidad de la ejecución.

¿Cuáles son los casos de uso comunes de MCP?

Los casos de uso típicos de MCP incluyen:

- Asistentes de codificación de IA

- Chatbots empresariales

- Agentes de IA autónomos

- Pipelines RAG con datos en tiempo real

- Herramientas internas de desarrollo

- Sistemas de automatización de flujos de trabajo

En cualquier lugar donde la IA necesite acceso seguro y estructurado a sistemas externos, MCP es aplicable.

¿Es MCP adecuado para sistemas empresariales y de producción?

Sí. MCP está diseñado para **implementaciones de grado de producción**.

Las características empresariales incluyen:

- Autenticación y autorización

- Observabilidad y rastreo

- Limitación de velocidad y cuotas

- Escalabilidad horizontal

- Tolerancia a fallos

MCP puede ser desplegado localmente para entornos sensibles o remotamente para plataformas a gran escala.

¿Cómo ayuda MCP con la escalabilidad y el mantenimiento?

MCP reduce drásticamente la sobrecarga de integración:

- Un servidor MCP puede atender a muchos clientes de IA

- Se pueden añadir nuevas herramientas sin cambios en el cliente

- Las integraciones son modulares y componibles

Esto reduce los costos de mantenimiento a largo plazo y permite una iteración más rápida a medida que evolucionan los sistemas de IA.

¿Se está convirtiendo MCP en un estándar de la industria?

MCP está emergiendo rápidamente como el **estándar predeterminado para la conectividad de IA a herramientas**.

Ya ha sido adoptado por:

- Entornos de desarrollo de IA

- Frameworks de agentes

- Asistentes de codificación

A medida que los sistemas de IA se vuelven más agentes y orientados a la acción, los protocolos estandarizados como MCP son cada vez más necesarios.

¿Deberían los desarrolladores y equipos aprender MCP ahora?

Sí. Los equipos que comprenden MCP temprano obtienen una ventaja estratégica.

El conocimiento de MCP ayuda con:

- Construcción de plataformas de IA escalables

- Diseño de flujos de trabajo de agente seguros

- Evitar la dependencia del proveedor

- Preparar las arquitecturas de IA para el futuro

A medida que la IA pasa de la generación a la ejecución, MCP se convierte en una infraestructura fundamental.