BlogAperçus de l'industrie

Bulle de l'IA ou cycle d'adoption ? Un guide pour les fondateurs

Konstantin BuzzResponsable de recherche

5 min de leitura

Le point de vue d'un réaliste prudent : là où la spéculation s'arrête et où le retour sur investissement reproductible commence – et comment juger de votre préparation à l'intelligence hybride.

Il y a une véritable frénésie autour de l'IA en ce moment. Tout le monde essaie de surfer sur la vague, et oui, il y a une bulle. La mentalité de la ruée vers l'or invite aux abus et aux raccourcis. La question n'est pas de savoir si la mousse existe, mais ce qui survit après qu'elle ait éclaté : est-ce une autre bulle Internet ? Ou est-ce une moderne crise de la tulipe, qui pourrait secouer davantage l'économie et la culture d'entreprise – voire les normes publiques.

Une nouvelle mise en garde : Deloitte a accepté de rembourser partiellement le gouvernement australien après qu'un rapport de 440 000 AU$ se soit avéré contenir des citations fabriquées et d'autres erreurs. Le cabinet a ensuite reconnu que des outils GenAI (Azure OpenAI / GPT-4o) avaient été utilisés dans la rédaction. Un bon rappel qu'en l'absence de validation appropriée et de contrôles humains, les outils « intelligents » deviennent des risques pour la marque.

Le greenwashing a cédé la place à l'AI washing – des affirmations exagérées ou trompeuses sur l'utilisation de l'IA. Les régulateurs tentent de cerner le problème : la SEC américaine a déjà intenté des actions pour de fausses déclarations sur l'IA et des violations de marketing.

Parallèlement, les dépenses des entreprises ne cessent de s'aggraver : IDC s'attend à ce que les dépenses mondiales en IA atteignent environ 632 milliards de dollars d'ici 2028. Ce ne sont pas des publications de battage médiatique, ce sont des lignes budgétaires.

L'ampleur est difficile à ignorer. Ces derniers mois, des rapports ont évalué OpenAI à près d'un demi-billion de dollars, et d'autres rapports signalent également des partenariats à l'échelle du billion avec des entreprises de cloud et de puces. Cela inclut des plans de centres de données de 10 gigawatts, des engagements cloud pluriannuels et un programme "Stargate" dont on dit qu'il ressemble plus à un projet énergétique qu'à une mise à niveau informatique. Comparez cela aux revenus actuels (d'ordres de grandeur inférieurs) et vous obtenez la dissonance qui fait crier au « bulle ».

Et pourtant, ce n'est pas seulement de l'air. Une cohorte de leaders parmi les entreprises axées sur l'IA enregistre déjà un ARR significatif. Les revenus d'OpenAI à la mi-2025 sont réels (des milliards, pas des millions). Les jeunes startups atteignent les seuils de revenus précoces plus rapidement que le SaaS classique. Sous le capot, les courbes capacité-prix continuent de s'infléchir : le même budget permet d'obtenir plus de production tous les quelques mois, même si la latence et les surcharges de contexte long compliquent le tableau. C'est pourquoi les acheteurs sérieux continuent de dépenser ; l'économie unitaire s'améliore à mesure que vous instrumentez le travail. Pourtant, les attentes et les dépenses d'investissement dépassent clairement le compte de profits et pertes actuel.

Les deux parties admettent une surchauffe. Les constructeurs et les investisseurs utilisent le mot « bulle » sans sourciller. MarketWatch estime qu'elle est « 17 fois la taille de la bulle Internet ». D'autres affirment que de nombreuses bulles industrielles ont laissé derrière elles des infrastructures utiles. Les régulateurs ajoutent une note de sobriété, avertissant que l'enthousiasme peut dépasser les fondamentaux et retomber rapidement.

Et pourtant, où se trouvera la valeur durable ?

La valeur durable ne provient pas des démonstrations. Une règle simple se maintient après chaque cycle de battage médiatique : si un flux de travail laisse des preuves, fait gagner un temps mesurable et peut être rejoué, il survit. S'il ne peut pas être mesuré ou audité, c'était du marketing. Trois modèles semblent devoir perdurer.

Flux de travail agencés.

Les agents feront le travail de fond — collecter, transformer, proposer — puis s'arrêteront pour une décision humaine là où réside le risque. Crucialement, ils laissent une trace que vous pouvez réexécuter : entrées, étapes, sorties et approbations. Et lorsque les agents sont connectés aux systèmes qui animent une entreprise — tâches, billetterie, communications, CRMs — leur production devient un changement d'état, pas un autre chat. Ce sont les agents pour lesquels les marchés continuent de payer.

RAG sur données privées.

Les modèles qui perdureront montreront leur travail. La génération augmentée par récupération (RAG) permet à un système de répondre à partir de sources approuvées et de les citer. En pratique, cela signifie une bibliothèque de documents propre et détenue, des règles d'accès claires et des mises à jour régulières afin que le matériel reste actuel. Associez cela à des contrôles de précision réguliers et à de simples garde-fous – une explication de l'origine d'une réponse et de ce que le modèle ne peut pas faire – et vous obtenez quelque chose que les investisseurs et les régulateurs apprécient : des réponses vérifiables et reproductibles.

Orchestration et télémétrie.

Les gagnants ressembleront moins à des chatbots et plus à des services que vous pouvez exécuter. Cela signifie des traces de bout en bout, le coût et la latence par réponse, des invites et des politiques versionnées, et une personne clairement responsable en cas de panne – le tout soutenu par des tableaux de bord, des alertes et des analyses post-mortem. Ajoutez un routage intelligent et une mise en cache afin que les questions faciles utilisent des modèles moins chers et que les réponses courantes ne soient pas recalculées. Lorsque les factures arrivent, seuls les systèmes instrumentés sont retenus.

Les interfaces auront de l'importance – mais pas de la manière que les pitch decks promettent. La voix est utile aujourd'hui pour la capture et le travail mains libres, mais elle reste plus lente et plus désordonnée que la saisie structurée – une option, pas une colonne vertéale.

Une perspective à trois ans

2025–2026 : le battage médiatique se dégonfle.

L'ère des "wrappers" perd de sa vigueur. Les applications similaires qui appellent un modèle de pointe et quelques outils s'estompent à mesure que les acheteurs se demandent si les sorties modifient l'état des systèmes centraux. Les "wrappers" minces cèdent la place à des produits dotés d'orchestration, de gestion des données et de pistes de preuves.

La ruée vers les API/AgentKit se poursuit – davantage de produits exposeront des moyens simples pour les agents d'agir ((API – la passerelle d'un produit ; kit d'agent – outils de démarrage pour que les agents l'utilisent ; lorsqu'il est capitalisé – la marque d'OpenAI)). Mais les bénéficiaires changent : d'ici 2026, les gagnants ressembleront moins à des chats et plus à des services dotés d'une colonne vertébrale. L'auto-vérification devient la norme : les invites récursives et les modèles multi-agents se répandent, avec des modèles qui critiquent leurs propres sorties ou les recoupent via des outils – augmentant la fiabilité sans ralentir les humains à la traîne.

L'inférence continue de devenir moins chère en moyenne – mais de manière inégale selon les tâches ; les contextes longs et le temps réel restent coûteux. Deux changements pratiques se font sentir :

— L'edge s'illumine : une augmentation des cas d'utilisation de l'IoT et de la robotique légère (inspection, picking et emballage, installations) exécutant de simples routines en boucle fermée.

— La gravité du protocole : les équipes se lassent des "colles" sur mesure ; des normes d'interaction émergent pour la manière dont les modèles appellent les outils, transmettent l'état et passent la main aux humains.

Quelques noms de marques trébuchent ; les touristes s'en vont. Les survivants exploitent des pipelines instrumentés avec un retour sur investissement mesurable. Des "pods" de livraison d'agents IA émergent dans des portées étroites – mettant en place des flux de travail de bout en bout (préparation des données → brouillon → révision → archivage) sous supervision humaine – utiles là où les règles sont strictes et la variance est faible. Les investisseurs se tournent vers la capitalisation de l'efficacité – optimiseurs, planificateurs, quantification/distillation et compression de mémoire qui génèrent des gains faibles mais fiables en termes de coût/latence.

2026–2027 : la lente courbe en S.

Les piles se stabilisent ; l'histoire passe des démos à l'utilité ennuyeuse – un peu comme le DevOps + le cloud dans les années 2010, lorsque l'expérimentation a cédé la place aux pipelines, aux SLA et aux tableaux de bord des coûts. Les entreprises construisent des bibliothèques internes d'outils/connaissances ; les achats demandent des fiches d'évaluation, la provenance et des plans indépendants des fournisseurs. La consolidation des protocoles s'accélère : des méthodes courantes pour décrire les tâches, les identifiants et les règles de sécurité permettent aux agents de se connecter aux CRM, ERP et systèmes d'usine sans travail sur mesure. Le capital favorise les équipes qui améliorent les métriques à la marge (temps de décision, $/réponse, succès@K (part des résultats corrects dans le top-K)) et prouvent qu'elles peuvent évoluer.

D'ici 2028 : le changement d'infrastructure.

La structure du marché se bifurque :

— Concentration de haut niveau : une poignée d'entreprises d'IA de premier rang assemblent des super-conglomérats autour du calcul, des données et (dans certains cas) du quantique – possédant les couches de CAPEX les plus lourdes.

— Gagnants viables parmi les PME/PMI : des spécialistes "AI-first" avec des implémentations disciplinées et sans erreur dans des flux de travail concrets – où les preuves, la reproductibilité et l'économie unitaire sont évidentes. Les acheteurs préfèrent les systèmes qui montrent une auditabilité en un coup d'œil ; dans les secteurs sensibles, les empreintes souveraines/on-prem deviennent des cases à cocher routinières.

L'IA se retire dans la plateforme – une option comme le stockage ou les files d'attente, pas un projet. Les budgets sont alloués aux opérations et au contrôle : SLA, télémétrie, réponse aux incidents, application des politiques.

Principaux risques – ce qui pourrait faire sortir une entreprise du marché

1) Défaillances de confiance (les tueurs rapides).

La confiance excessive dans les modèles, la sous-vérification des résultats et l'"AI washing" érodent rapidement la crédibilité. Une erreur publique ou une affirmation trompeuse peut fermer des portes avec les clients et les régulateurs. Atténuer : points de contrôle humains sur les actions risquées, preuves/citations par défaut, divulgations en langage clair.

2) Exposition et sécurité des données.

Fuites de contexte via les journaux, les caches ou l'injection de prompts ; jonctions d'API bâclées ; rétention unclear. Une seule brèche peut être existentielle. Atténuer : accès au moindre privilège, isolation du contexte, red-teaming, hygiène des secrets, politiques de rétention claires.

3) Effondrement de l'économie unitaire.

Les coûts invisibles d'observabilité, d'évaluations et de retravail explosent ; les cas d'utilisation à contexte long et en temps réel font grimper les dépenses ; la latence ne respecte pas les SLA. Atténuer : coût/latence par réponse sur les tableaux de bord, routage et mise en cache des modèles, contextes bornés, interrupteurs d'arrêt pour les tâches incontrôlées.

4) Verrouillage et fragilité des fournisseurs.

Une dépendance excessive à un seul modèle/fournisseur vous expose à des pannes, des changements de politique ou des modifications de prix. Atténuer : abstraction multi-modèles, invites/évaluations exportables, clauses de sortie de contrat.

5) Conformité et responsabilité.

Règles sectorielles (PII (informations personnellement identifiables), propriété intellectuelle, auditabilité) et attention des régulateurs aux allégations trompeuses. Atténuer : flux de données cartographiés, pistes d'audit, évaluations documentées, approbation juridique du langage marketing.

6) Goulots d'étranglement structurels.

L'énergie, les puces et l'approvisionnement en données propres peuvent freiner la croissance ou bloquer les dépenses d'investissement à mesure que les générations technologiques évoluent. Atténuer : plans de capacité échelonnés, gestion des données et seuils de ROI conservateurs pour les grands projets.

Vers l'intelligence hybride

Cela se produit, avec ou sans notre permission. Les machines prendront en charge bien plus de travail – d'ordres de grandeur plus – qu'elles ne l'ont déjà fait. Cela ne signifie pas un affrontement homme contre machine dans un horizon à moyen terme réaliste. Cela signifie que nos décisions, projets et services seront de plus en plus produits par des hybrides : des personnes, des modèles et des systèmes de données travaillant comme un seul tissu.

Pensez à l'intelligence hybride comme à un nuage de cognition partagée. Les algorithmes apportent vitesse et mémoire ; les humains ajoutent jugement, valeurs et contexte ; les systèmes d'entreprise fournissent les enregistrements ; les gouvernements établissent les règles – avec un retard à la mode. Les organisations qui restent connectées à ce tissu – où l'intelligence hybride peut lire les bonnes sources, agir dans les bons systèmes et montrer son travail – avanceront simplement plus vite et feront moins d'erreurs évitables. Nous nous attendons également à ce que les systèmes d'IA agentique exécutent le cycle complet scientifique/R&D – de la proposition d'hypothèses et la conception d'expériences à l'exécution d'analyses et la rédaction de soumissions – tandis qu'un chercheur principal humain les oriente vers les bonnes questions.

L'intelligence hybride est une division du travail. Ceux qui restent déconnectés se sentiront lents – une mule sur une autoroute : temps de décision plus long, parcours client plus faibles, opérations fragiles. La forme qui perdure après la bulle est simple : laisser les modèles faire ce qu'ils font le mieux, garder les humains là où le jugement compte, et relier les deux via des systèmes qui préservent les preuves.

Dans un avenir prévisible, les interfaces densifieront le tissage. Les wearables et l'audio ambiant transformeront les réunions et le travail sur le terrain en contexte utilisable ; des invites légères se trouveront dans les outils où le travail se produit déjà. À l'horizon, les interfaces neurales pourraient ouvrir un lien à haute bande passante entre les systèmes d'IA et l'intention humaine.

Le dernier kilomètre : comment se préparer – et à quoi ressemble déjà l'“hybride”

Travailler ensemble, tôt.

Commencez par bâtir des équipes mixtes – humains et agents dans la même boucle. Demandez à l'IA de faire des recherches – puis de se vérifier elle-même et l'équipe. Apprenez aux gens à collaborer avec l'IA, à en tirer des leçons et à la réenseigner (pair-ops, playbooks).

Restez attentif aux modèles, aux règles et aux prix.

Suivez les principales mises à jour des modèles et les évolutions réglementaires (règles locales de confidentialité et sectorielles). Gardez un œil sur les prix afin de ne pas dépenser excessivement en jetons et en contexte. Une habitude simple : un document mensuel d'une page avec « ce qui a changé », les écarts de coûts et l'impact sur vos flux de travail.

Pratiquez l'hygiène des données.

Inventoriez et approuvez vos sources. Décidez quelles sont les 'données d'or', qui les maintient et à quelle fréquence elles sont rafraîchies. Supprimez ou masquez les PII (informations personnellement identifiables). Définissez les règles de rétention. Contrôlez les caches et les couches temporaires pour que les contextes sensibles ne fuient pas dans les journaux.

Intégrez l'humain dans la boucle aux points de décision.

Définissez les points de contrôle, les rôles et les protocoles d'escalade pour les étapes à haut risque. Faites en sorte que les approbations fassent partie de l'artefact (qui a signé, quand, sur quelles preuves).

Auditez l'accès et ajoutez de la télémétrie.

Si vous ne pouvez pas le voir, vous ne pouvez pas le faire évoluer. Connaissez le flux de travail. Découvrez qui peut lire/écrire quelles sources, ce qui est enregistré et qui l'a approuvé. Mettez en place des traces de bout en bout. Suivez les versions des modèles, la consommation de jetons et la latence par réponse.

Choisissez votre empreinte : cloud ou souveraine.

Lorsque la politique ou les contrats clients l'exigent, prévoyez des déploiements sur site. Sinon, expliquez clairement pourquoi le cloud est acceptable et comment vous vous retirerez si nécessaire.

Essayez la collaboration hybride

Le changement est déjà visible dans les outils qui cohabitent avec le travail, plutôt qu'en dehors. Un schéma typique :

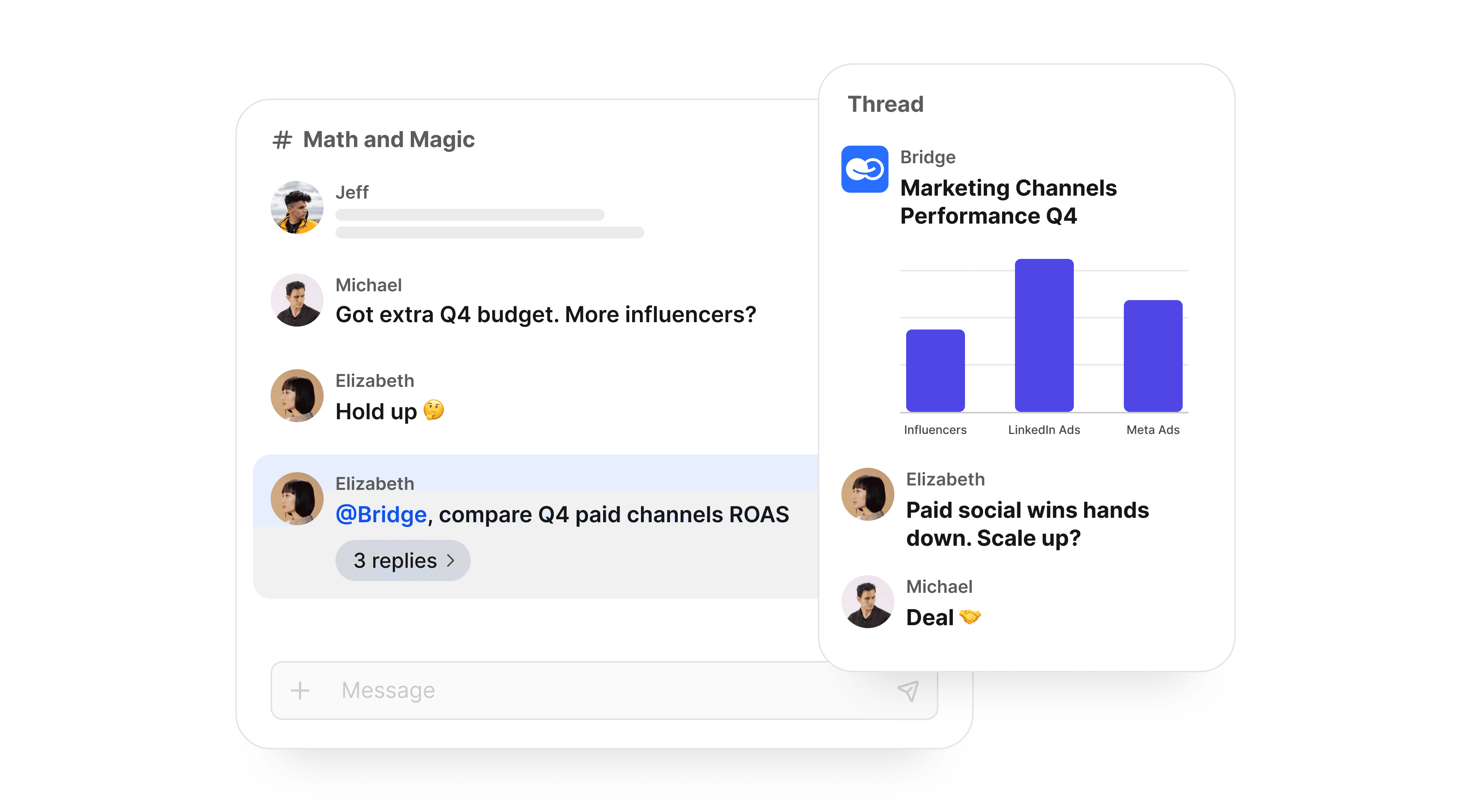

- Les flux agencés tirent des informations de connaissances approuvées, élaborent un plan et s'arrêtent aux points de contrôle HITL (Human-In-The-Loop) pour jugement.

- Le RAG sur données privées fonde les réponses sur des citations issues de vos documents, tickets et journaux.

- L'orchestration et la télémétrie tracent chaque étape, avec le coût/latence par réponse sur un tableau de bord et des invites/politiques versionnées pour l'audit.

- L'intégration système signifie que le résultat n'est pas une transcription – c'est un ticket déposé, un enregistrement mis à jour, un flux de travail avancé.

Ces principes façonnent déjà une nouvelle classe de plateformes collaboratives.

BridgeApp en est une, construite sur ces bases. Les agents ne discutent pas pour le plaisir : l'IA gère les tâches routinières, les décisions sont plus rapides, les transferts sont moins nombreux et la logique est observable. Vous pouvez montrer les résultats aux auditeurs, aux clients et à votre propre équipe.

Découvrez comment BridgeApp peut générer de réels changements d'état dans votre entreprise.