BlogAperçus de l'industrie

Un Guide Complet du Protocole de Contexte de Modèle (MCP) : Architecture, Intégration et Bonnes Pratiques

Équipe BridgeApp

7 min de lecture

Qu'est-ce que le MCP (Protocole de Contexte de Modèle) ?

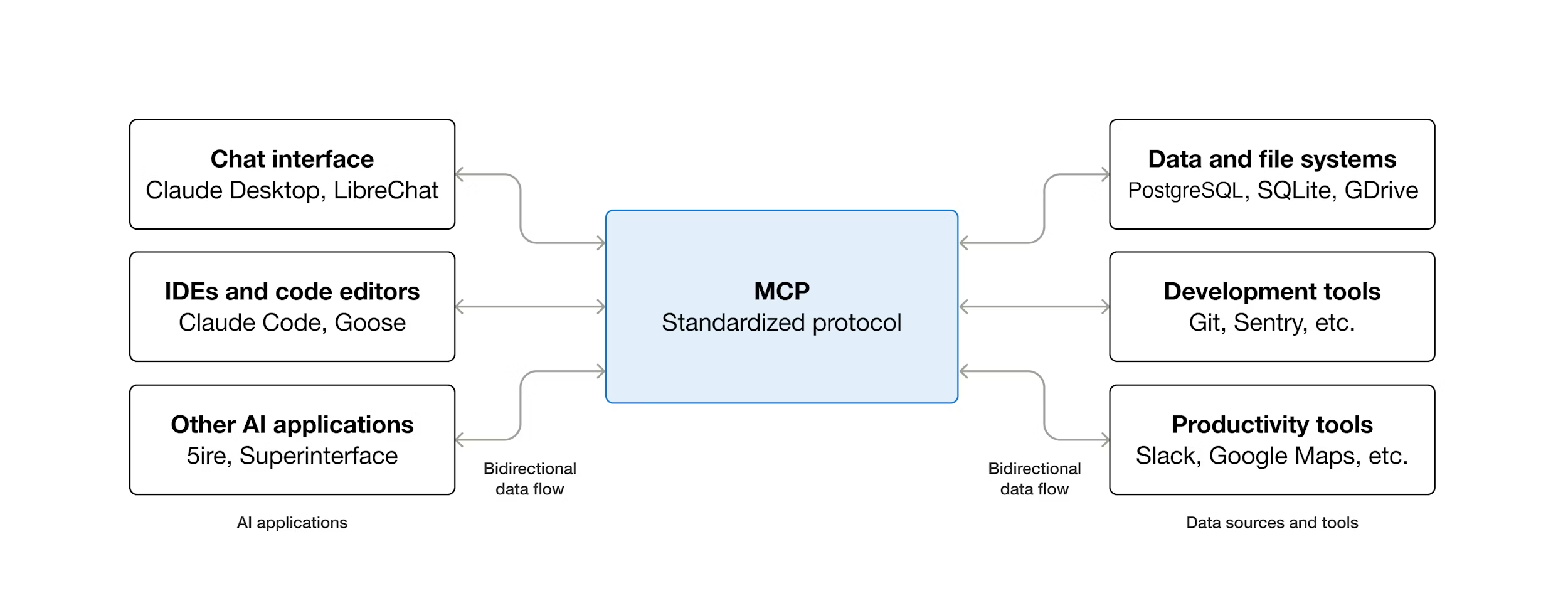

Le Protocole de Contexte de Modèle (MCP) est un standard ouvert introduit par Anthropic en novembre 2024 qui définit comment les modèles d'IA se connectent en toute sécurité aux outils externes, bases de données et services.

Pensez au MCP comme au **USB-C des intégrations d'IA** : un standard universel qui permet à toute application d'IA de se connecter à n'importe quelle source de données ou outil, sans adaptateurs personnalisés pour chaque paire.

Les grands modèles de langage (LLM) sont très performants en matière de raisonnement et de génération de texte, mais ils ont une limitation fondamentale : ils ne peuvent pas accéder aux données du monde réel ni invoquer des outils externes par eux-mêmes. Le MCP a été conçu pour résoudre précisément ce problème.

Contrairement à un simple wrapper d'API, un serveur MCP fait bien plus que traduire les appels HTTP. Il gère l'état de la session, applique le contrôle d'accès, expose un menu structuré de capacités et garantit que les modèles d'IA reçoivent des informations précises, opportunes et contextuellement pertinentes.

**Définition rapide :** Le MCP est un protocole client-serveur bâti sur JSON-RPC 2.0 qui permet aux applications d'IA de découvrir et d'appeler des outils et sources de données externes via une interface unique et standardisée.

Architecture et Composants du MCP

À la base, le MCP définit une architecture client-serveur bâtie sur JSON-RPC 2.0 – un standard de procédure d'appel à distance ouvert et léger.

Cette conception résout le classique **problème N×M** : connecter N modèles d'IA différents à M sources de données différentes sans écrire N×M adaptateurs personnalisés.

L'architecture MCP se compose de quatre composants principaux :

- Hôte MCP

- Client MCP

- Serveur MCP

- Couche de Transport

Couche de Transport

Les serveurs MCP peuvent communiquer :

- **Localement via stdio** — pour les déploiements sur la même machine

- **À distance via HTTP (HTTP en flux)** — pour les systèmes distribués

Les connexions distantes nécessitent HTTPS avec une authentification appropriée. Les connexions locales sont adaptées aux environnements de développement ou aux déploiements étroitement contrôlés.

Hôte MCP

L'hôte MCP est l'environnement d'application de haut niveau où un assistant IA opère. Les exemples incluent :

- IDE

- Interfaces de chat

- Frameworks d'agents autonomes

L'hôte est responsable de :

- Découvrir les serveurs MCP disponibles

- Orchestrer les requêtes vers ces serveurs

- Afficher des invites de permission pour les opérations sensibles

Au démarrage de la session, l'hôte effectue une négociation de découverte pour connaître les outils, ressources et invites disponibles. Pour les actions risquées (par exemple, l'écriture sur un système de fichiers), l'hôte impose une confirmation et une supervision humaine.

Client MCP

Le client MCP réside à l'intérieur de l'hôte et maintient une connexion un-à-un avec un seul serveur MCP.

Ses responsabilités incluent :

- Traduire l'intention de haut niveau en requêtes JSON-RPC

- Enregistrer les capacités du serveur

- Normaliser et relayer les réponses à l'hôte

Au début de la session, le client effectue **l'enregistrement des capacités**, interrogeant le serveur pour les méthodes disponibles et les mettant en cache pour une utilisation au moment de l'inférence.

SDKs Pris en Charge

Les SDK officiels sont disponibles pour :

- Python

- TypeScript

- Java

- Kotlin

- C#

Exemple : Initialisation d'un client MCP en Python

from mcp import ClientSession, StdioServerParameters

from mcp.client.stdio import stdio_client

server_params = StdioServerParameters(

command="python",

args=["my_mcp_server.py"]

)

async with stdio_client(server_params) as (read, write):

async with ClientSession(read, write) as session:

await session.initialize()

tools = await session.list_tools()

print(tools)

Serveur MCP

Le serveur MCP est le service externe qui fournit des données, du contexte ou des capacités au LLM. Il se situe entre le modèle d'IA et les systèmes sous-jacents tels que :

- Bases de données

- API

- Plateformes SaaS

- Systèmes de fichiers

Principales Capacités Exposées par les Serveurs MCP

- **Outils** — actions exécutables (par exemple, requêtes SQL, problèmes GitHub)

- **Ressources** — données en lecture seule (schémas, fichiers, articles de la base de connaissances)

- **Invites** — modèles d'instructions prédéfinis

Exemple : Définition d'un outil dans un serveur MCP

from mcp.server import Server

from mcp.server.models import InitializationOptions

import mcp.types as types

server = Server("my-server")

@server.list_tools()

async def list_tools() -> list[types.Tool]:

return [

types.Tool(

name="get_sales_summary",

description="Fetch last month's sales data from the database",

inputSchema={

"type": "object",

"properties": {

"month": {

"type": "string",

"description": "Month in YYYY-MM format"

}

},

"required": ["month"]

}

)

]

MCP vs API vs Appel de Fonction

| Caractéristique | API Traditionnelle | Appel de Fonction | MCP |

|---|---|---|---|

| Standardisation | Personnalisée par service | Spécifique au modèle | Universelle |

| Découverte | Docs manuelles | Schéma statique | Exécution |

| Support multi-outils | Personnalisé par N×M | Limitée | Intégrée |

| Session/état | Côté application | Aucun | Côté serveur |

| Standard ouvert | Non | Non | Oui |

| Verrouillage fournisseur | Élevé | Moyen | Faible |

**Distinction clé :**

L'appel de fonction invoque une fonction à l'intérieur d'une application. Le MCP permet à toute application d'IA compatible MCP de découvrir et d'appeler n'importe quel serveur MCP dynamiquement au moment de l'exécution.

Contrôle d'Accès et Sécurité

La sécurité est fondamentale dans les déploiements MCP.

Les bonnes pratiques incluent :

- HTTPS pour les serveurs distants

- Clés API, jetons ou OAuth pour l'authentification

- Permissions délimitées par méthode d'outil (privilège minimum)

Pour les opérations risquées (écritures, suppressions, messages sortants), les serveurs MCP devraient exiger des invites de permission explicites, garantissant une supervision humaine même dans les flux de travail automatisés.

MCP dans BridgeApp : Transformer votre espace de travail en un système agentique

Grâce au support natif du MCP, BridgeApp devient un environnement entièrement interopérable où les agents IA, les outils et les données opèrent au sein d'une seule couche de contexte. Il est désormais possible d'intégrer n'importe lequel de vos outils via le MCP pour créer des flux de travail complexes alimentés par notre moteur d'IA. Connectez vos outils existants une fois. À partir de ce moment, nous gérons les flux de travail complexes et multi-étapes qui prenaient auparavant le temps de votre équipe : routage des requêtes, mise à jour des enregistrements, déclenchement d'actions entre les systèmes et maintien de la synchronisation de chaque département, automatiquement.

Comment connecter un serveur MCP externe dans BridgeApp ?

**La réponse courte : c'est dans Agents → Serveurs MCP, et cela prend environ deux minutes.**

La réponse plus longue commence par ce qui se passe réellement lorsque vous vous connectez. Vous collez l'URL du serveur MCP — généralement trouvée dans la documentation du fournisseur —, choisissez le type d'authentification requis par le serveur, et BridgeApp fait le reste. Il récupère automatiquement chaque méthode disponible de ce serveur et les liste avec des descriptions. Vous voyez exactement ce que l'intégration peut faire avant de construire quoi que ce soit avec.

Les options d'authentification couvrent la plupart des configurations courantes : pas d'authentification, code d'autorisation, identifiants client, jeton d'espace de travail, jeton utilisateur ou code d'authentification d'espace de travail — selon ce que votre fournisseur prend en charge.

Pour être concret : nous avons connecté Ahrefs pour notre équipe marketing. Nous avons créé un agent d'analyse. Nous lui avons donné accès au MCP d'Ahrefs. L'agent extrait désormais des données de recherche en direct et répond aux questions SEO directement dans BridgeApp, dans le même chat où le reste du travail se déroule.

Intégrations MCP avec les Systèmes et Agents d'IA

Le MCP permet aux agents IA de :

- Lire des fichiers

- Interroger des bases de données

- Appeler des API externes

- Écrire les résultats dans les systèmes source

Le tout au sein d'un seul flux de travail, sans code d'intégration personnalisé.

Les clients MCP courants incluent :

- Assistants de codage

- Frameworks d'agents autonomes

- Chatbots d'entreprise

- Pipelines RAG

Flux d'Intégration d'Agent Typique

- Enregistrer les capacités du serveur MCP

- Fournir des métadonnées riches pour chaque outil

- Invoquer des outils via le client MCP pendant l'inférence

De meilleures métadonnées améliorent la fiabilité de la sélection des outils.

Appel de Fonction et IA Agentique

Le MCP formalise et étend l'appel de fonctions en exposant des outils via une interface unifiée et découvrable.

Cela permet un véritable comportement agentique :

- Lire l'intention de l'utilisateur

- Sélectionner des outils

- Exécuter des actions

- Décider des prochaines étapes de manière autonome

Le MCP prend également en charge **l'élicitation** — la demande d'informations manquantes avant l'exécution — et maintient la mémoire de session à travers plusieurs appels d'outils.

Modèles d'Intégration MCP

Serveurs de Bases de Données

Exposez des méthodes de requête sûres et paramétrées plutôt que du SQL brut.

Serveurs de Systèmes de Fichiers

Fournissez un accès en lecture/écriture délimité à l'aide de répertoires racines.

Intégrations SaaS

Gérez l'authentification, la limitation de débit et la normalisation des données en interne tout en exposant une interface propre au modèle d'IA.

Bonnes Pratiques pour les Serveurs MCP

- Documentation JSON Schema claire

- Codes d'erreur structurés

- Validation stricte des entrées

- Limitation de débit

- Composabilité dynamique et conception modulaire

Ces pratiques permettent aux serveurs MCP de s'adapter aux systèmes complexes multi-agents.

Sources de Données et Données Externes

Chaque source de données doit être enregistrée avec :

- Un schéma de réponse clair

- Sorties validées

- Accès délimité (par exemple, répertoires racines du système de fichiers)

Cela réduit les hallucinations et applique le principe du moindre privilège.

Observabilité et Surveillance

Suivi :

- Percentiles de latence par outil

- Taux d'erreur

- Sessions actives et succès de cache

- Débit sous charge

Le traçage de bout en bout est essentiel pour déboguer le comportement des agents.

Déploiement : Serveurs MCP Locaux vs Distants

Déploiement Local

Idéal pour les outils de développement et les environnements contrôlés.

Déploiement Distant

Idéal pour les systèmes d'entreprise et les plateformes multi-utilisateurs.

Considérations de production :

- Mise à l'échelle automatique

- Mise en cache

- Tolérance aux pannes et redondance

FAQ : Protocole de Contexte de Modèle

Qu'est-ce que le Protocole de Contexte de Modèle (MCP) en termes simples ?

Le Protocole de Contexte de Modèle (MCP) est un moyen ouvert et standardisé pour les modèles et agents d'IA d'interagir en toute sécurité avec des outils externes, des bases de données, des API et des services.

En termes simples, le MCP agit comme un **pont universel entre l'IA et le monde réel**. Au lieu de coder en dur les intégrations pour chaque outil, le MCP permet aux applications d'IA de découvrir, comprendre et utiliser dynamiquement des capacités externes via un protocole unique. Cela rend les systèmes d'IA plus flexibles, évolutifs et fiables.

Qui a créé le MCP et pourquoi a-t-il été introduit ?

Le MCP a été introduit par **Anthropic en novembre 2024** en tant que standard ouvert.

La motivation derrière le MCP était de résoudre un problème croissant en ingénierie de l'IA : les systèmes d'IA modernes ont besoin d'accéder à des données et des outils en temps réel, mais les approches existantes (API personnalisées et appel de fonctions) ne s'adaptent pas bien. Le MCP a été conçu pour :

- Réduire la complexité d'intégration

- Éliminer le verrouillage fournisseur

- Permettre des flux de travail d'IA agentique sûrs

- Standardiser la communication de l'IA vers les outils

Bien que créé par Anthropic, le MCP **n'est pas propriétaire** et est destiné à une large adoption industrielle.

Le MCP est-il open source et indépendant des fournisseurs ?

Oui. Le MCP est à la fois **open source** et **neutre vis-à-vis des fournisseurs**.

- La spécification du protocole est publique

- Les implémentations de référence sont maintenues par la communauté

- Toute entreprise ou individu peut implémenter des serveurs ou clients MCP

Cette ouverture est essentielle pour éviter la fragmentation de l'écosystème et garantir que le MCP puisse être utilisé avec différents modèles d'IA, frameworks et fournisseurs d'infrastructure.

En quoi le MCP est-il différent d'une API traditionnelle ?

Une API traditionnelle exige des développeurs qu'ils écrivent du code d'intégration personnalisé pour chaque client et chaque cas d'utilisation. Cela conduit rapidement à des systèmes fragiles et à un effort dupliqué.

Le MCP diffère de plusieurs manières clés :

- **Découverte dynamique** : les modèles d'IA peuvent découvrir des outils au moment de l'exécution

- **Interface standardisée** : pas d'adaptateurs personnalisés par intégration

- **Contexte géré par le serveur** : l'état et les permissions sont gérés de manière centralisée

- **Conception axée sur l'IA** : les schémas et les métadonnées sont optimisés pour le raisonnement des LLM

En bref, les API sont conçues pour les humains et les applications. Le MCP est conçu **pour les systèmes d'IA**.

Quelle est la différence entre le MCP et l'appel de fonction LLM ?

L'appel de fonction permet à un LLM d'invoquer des fonctions prédéfinies au sein d'une seule application. Ces fonctions sont généralement codées en dur et étroitement liées à l'application.

Le MCP va beaucoup plus loin :

- Les outils sont exposés par des **serveurs externes**, non intégrés à l'application

- Les capacités sont découvertes **dynamiquement** au moment de l'exécution

- Le MCP fonctionne avec différents fournisseurs, langages et plateformes

- L'état de la session et les permissions sont gérés côté serveur

L'appel de fonction est une fonctionnalité. Le MCP est un **protocole au niveau de l'écosystème**.

Le MCP peut-il fonctionner avec n'importe quel modèle d'IA ou LLM ?

Oui. Le MCP est **agnostique au modèle**.

- Il fonctionne avec :

- Claude

- Modèles GPT

- Gemini

- LLM open source

- Tout modèle supportant l'utilisation d'outils ou une sortie structurée

Le MCP ne dépend pas d'une architecture de modèle spécifique. Tant qu'un système d'IA peut interpréter les schémas d'outils et produire des appels structurés, il peut utiliser le MCP.

Quels problèmes le MCP résout-il pour les agents d'IA ?

Le MCP permet aux agents d'IA de dépasser la génération de texte statique et de devenir des **systèmes capables d'action**.

Problèmes clés que le MCP résout :

- Accès sécurisé aux données en temps réel

- Invocation fiable des outils

- Mémoire de session persistante

- Exécution d'actions avec permissions

- Orchestration multi-outils évolutive

Cela rend le MCP fondamental pour **l'IA agentique**, où les systèmes planifient, agissent, observent les résultats et itèrent de manière autonome.

Que sont les outils, ressources et invites MCP ?

Les serveurs MCP exposent trois types de capacités primaires :

- **Outils** : Actions exécutables (par exemple, requêtes de base de données, écritures de fichiers, appels d'API)

- **Ressources** : Sources de données en lecture seule (fichiers, schémas, documents)

- **Invites** : Modèles d'instructions prédéfinis pour un comportement cohérent du modèle

Cette séparation améliore la sécurité, la clarté et la qualité du raisonnement pour les LLM.

Comment le MCP gère-t-il la sécurité et le contrôle d'accès ?

La sécurité est un principe de conception fondamental du MCP.

Les bonnes pratiques incluent :

- HTTPS pour les serveurs MCP distants

- Clés API, jetons ou authentification OAuth

- Permissions granulaires par méthode d'outil

- Approbation explicite de l'utilisateur pour les opérations risquées

Le MCP suit un **modèle de moindre privilège**, garantissant que les systèmes d'IA n'accèdent qu'à ce qu'ils sont explicitement autorisés à utiliser.

Le MCP peut-il maintenir le contexte et la mémoire entre les sessions ?

Oui. Les serveurs MCP peuvent maintenir **l'état et la mémoire au niveau de la session**.

Cela permet :

- Flux de travail multi-étapes

- Tâches d'agent de longue durée

- Persistance du contexte à travers plusieurs appels d'outils

La gestion de session est gérée côté serveur, rendant les agents d'IA plus fiables et moins fragiles.

Comment le MCP réduit-il les hallucinations dans les systèmes d'IA ?

Le MCP réduit les hallucinations en :

- Imposant des schémas structurés pour les entrées et les sorties

- Fournissant des contrats explicites pour les outils et les données

- Validant les réponses avant de les retourner au modèle

- Limitant l'accès aux ressources bien définies

En contraignant ce que le modèle peut voir et faire, le MCP améliore l'ancrage factuel et la fiabilité de l'exécution.

Quels sont les cas d'utilisation courants du MCP ?

Les cas d'utilisation typiques du MCP incluent :

- Assistants de codage IA

- Chatbots d'entreprise

- Agents IA autonomes

- Pipelines RAG avec données en direct

- Outils de développement internes

- Systèmes d'automatisation de flux de travail

Partout où l'IA a besoin d'un accès sécurisé et structuré aux systèmes externes, le MCP est applicable.

Le MCP est-il adapté aux systèmes d'entreprise et de production ?

Oui. Le MCP est conçu pour les **déploiements de niveau production**.

Les fonctionnalités d'entreprise incluent :

- Authentification et autorisation

- Observabilité et traçage

- Limitation de débit et quotas

- Évolutivité horizontale

- Tolérance aux pannes

Le MCP peut être déployé localement pour les environnements sensibles ou à distance pour les plateformes à grande échelle.

Comment le MCP aide-t-il à la scalabilité et à la maintenance ?

Le MCP réduit considérablement la surcharge d'intégration :

- Un serveur MCP peut servir de nombreux clients IA

- De nouveaux outils peuvent être ajoutés sans modifications côté client

- Les intégrations sont modulaires et composables

Cela réduit les coûts de maintenance à long terme et permet une itération plus rapide à mesure que les systèmes d'IA évoluent.

Le MCP est-il en train de devenir un standard de l'industrie ?

Le MCP est en train de s'imposer rapidement comme le **standard par défaut pour la connectivité de l'IA aux outils**.

Il a déjà été adopté par :

- Environnements de développement IA

- Frameworks d'agents

- Assistants de codage

À mesure que les systèmes d'IA deviennent plus agentiques et orientés vers l'action, les protocoles standardisés comme le MCP deviennent de plus en plus nécessaires.

Les développeurs et les équipes devraient-ils apprendre le MCP maintenant ?

Oui. Les équipes qui comprennent le MCP tôt obtiennent un avantage stratégique.

La connaissance du MCP aide à :

- Construire des plateformes d'IA évolutives

- Concevoir des flux de travail agentiques sécurisés

- Éviter le verrouillage fournisseur

- Pérenniser les architectures d'IA

À mesure que l'IA passe de la génération à l'exécution, le MCP devient une infrastructure fondamentale.