БлогInsights da indústria

Bolha da IA ou ciclo de adoção? Um Guia para Fundadores

Konstantin BuzzLíder de Pesquisa

5 мин чтения

A visão de um realista cauteloso: onde a especulação termina e o ROI repetível começa – e como julgar sua prontidão para a inteligência híbrida.

Há um verdadeiro frenesi em torno da IA agora. Todos estão tentando pegar a onda, e sim – há uma bolha. A mentalidade da corrida do ouro convida a abusos e atalhos. A questão não é se a espuma existe, mas o que sobrevive depois que ela estoura: é esta outra bolha ponto com? Ou é uma moderna mania das tulipas, que poderia abalar ainda mais a economia e a cultura empresarial – se não as normas públicas.

Uma nova história de advertência: a Deloitte concordou em reembolsar parcialmente o governo da Austrália depois que um relatório de AU$ 440.000 foi considerado contendo citações fabricadas e outros erros. A empresa posteriormente reconheceu que ferramentas GenAI (Azure OpenAI / GPT-4o) foram usadas na redação. Um bom lembrete de que, sem validação adequada e controles "humano no loop", ferramentas "inteligentes" se tornam riscos para a marca.

O "greenwashing" deu lugar ao "AI washing" – alegações exageradas ou enganosas sobre o uso da IA. Os reguladores estão tentando cercar isso: a SEC dos EUA já abriu processos por alegações falsas de IA e violações de marketing.

Em paralelo, os gastos empresariais continuam a aumentar: a IDC espera que o gasto global em IA atinja aproximadamente US$ 632 bilhões até 2028. Isso não são posts de hype – são linhas orçamentárias.

A escala é difícil de ignorar. Nos últimos meses, relatórios avaliaram a OpenAI em quase meio trilhão de dólares, com relatórios também apontando para parcerias na escala de trilhões com empresas de nuvem e chips. Isso inclui planos de data centers de 10 gigawatts, compromissos de nuvem plurianuais e um rumoroso programa "Stargate" que soa mais como um projeto de energia do que uma atualização de TI. Compare isso com a receita atual (ordens de magnitude menores) e você terá a dissonância que faz as pessoas gritarem "bolha".

E, no entanto, não é apenas ar. Uma coorte líder de empresas "AI-first" já está registrando um ARR (Receita Recorrente Anual) significativo. A receita da OpenAI em meados de 2025 é real (bilhões, não milhões). Startups mais jovens estão atingindo os limites de receita iniciais mais rapidamente do que o SaaS clássico. Sob o capô, as curvas de capacidade-preço continuam a se curvar: o mesmo orçamento compra mais produção a cada poucos meses, mesmo que a latência e as sobretaxas de contexto longo compliquem o cenário. É por isso que compradores sérios continuam gastando; a economia unitária melhora à medida que você instrumentaliza o trabalho. No entanto, as expectativas e os gastos de capital claramente superam o P&L atual.

Ambas as tribos admitem o superaquecimento. Construtores e investidores usam a palavra “bolha” sem pestanejar. MarketWatch estima que ela é '17 vezes o tamanho da bolha ponto com'. Outros argumentam que muitas bolhas industriais deixaram para trás infraestrutura útil. Os reguladores adicionam uma nota sóbria – alertando que o entusiasmo pode superar os fundamentos e recuar rapidamente.

E, no entanto – onde o valor duradouro será encontrado?

O valor duradouro não vem de demonstrações. Uma regra simples se mantém após cada ciclo de hype: se um fluxo de trabalho deixa evidências, economiza tempo mensurável e pode ser reproduzido, ele sobrevive. Se não puder ser medido ou auditado, era marketing. Três padrões parecem prontos para perdurar.

Fluxos de trabalho agênticos.

Os agentes farão o trabalho pesado – coletar, transformar, propor – e então pararão para uma decisão humana onde reside o risco. Crucialmente, eles deixam um rastro que você pode executar novamente: entradas, etapas, saídas e aprovações. E quando os agentes são conectados aos sistemas que movem uma empresa – tarefas, emissão de tickets, comunicações, CRMs – sua saída se torna uma mudança de estado, não mais um chat. Esses são os agentes pelos quais os mercados continuam pagando.

RAG em dados privados.

Os modelos que perdurarem mostrarão seu trabalho. A geração aumentada por recuperação (RAG) permite que um sistema responda a partir de fontes aprovadas e as cite. Na prática, isso significa uma biblioteca de documentos limpa e própria, regras de acesso claras e atualizações rotineiras para que o material permaneça atual. Combine isso com verificações regulares de precisão e guard-rails simples – uma explicação de onde veio uma resposta e o que o modelo não pode fazer – e você terá algo que tanto investidores quanto reguladores gostam: respostas verificáveis e repetíveis.

Orquestração e telemetria.

Os vencedores se parecerão menos com chatbots e mais com serviços que você pode executar. Isso significa rastreamentos de ponta a ponta, custo e latência por resposta, prompts e políticas versionadas, e alguém claramente responsável quando as coisas falham – tudo isso apoiado por painéis, alertas e análises post-mortem. Adicione roteamento inteligente e cache para que perguntas fáceis usem modelos mais baratos e respostas comuns não sejam recalculadas. Quando as contas chegarem, apenas os sistemas instrumentados passarão no corte.

As interfaces importarão – mas não da maneira que os pitch decks prometem. A voz é útil hoje para captura e trabalho mãos-livres, mas ainda é mais lenta e desordenada do que a entrada estruturada – uma opção, não uma espinha dorsal.

Uma perspectiva de três anos

2025–2026: o hype diminui.

A era dos "wrappers" perde força. Aplicativos semelhantes que chamam um modelo de fronteira e algumas ferramentas desaparecem à medida que os compradores questionam se as saídas alteram o estado nos sistemas centrais. Os "wrappers" finos dão lugar a produtos com orquestração, gestão de dados e trilhas de evidências.

A corrida por API/AgentKit continua – mais produtos exporão maneiras simples para os agentes agirem ((API – a porta de entrada de um produto; kit de agente – ferramentas iniciais para os agentes o usarem; quando capitalizado – a marca da OpenAI)). Mas os beneficiários mudam: até 2026, os vencedores se parecerão menos com chats e mais com serviços com uma espinha dorsal. A auto-verificação se torna padrão: prompts recursivos e padrões multiagentes se espalham, com modelos criticando suas próprias saídas ou fazendo verificação cruzada via ferramentas – aumentando a confiabilidade sem diminuir o ritmo dos humanos.

A inferência continua ficando mais barata em média – mas de forma desigual entre as tarefas; contextos longos e em tempo real permanecem caros. Duas mudanças práticas se impõem:

— A borda se ilumina: um aumento de casos de uso de IoT e robótica leve (inspeção, coleta e embalagem, instalações) executando rotinas simples de ciclo fechado.

— Gravidade do protocolo: as equipes se cansam de "colar" soluções sob medida; padrões de interação surgem para como os modelos chamam ferramentas, passam o estado e entregam o controle aos humanos.

Alguns nomes de marcas tropeçam; os turistas partem. Os sobreviventes operam pipelines instrumentados com retorno mensurável. "Pods" de entrega de agentes de IA emergem em escopos restritos – estabelecendo fluxos de trabalho de ponta a ponta (preparação de dados → rascunho → revisão → arquivo) sob supervisão humana – úteis onde as regras são estritas e a variância é baixa. Investidores se voltam para a otimização da eficiência – otimizadores, agendadores, quantização/destilação e compressão de memória que geram pequenos, mas confiáveis, ganhos de custo/latência.

2026–2027: a lenta curva em S.

As pilhas se estabilizam; a história passa das demos para a utilidade entediante – muito parecido com DevOps + nuvem na década de 2010, quando a experimentação deu lugar a pipelines, SLAs e painéis de custo. As empresas constroem bibliotecas internas de ferramentas/conhecimento; a aquisição exige scorecards de avaliação, proveniência e planos neutros em relação ao fornecedor. A consolidação do protocolo acelera: formas comuns de descrever tarefas, credenciais e regras de segurança permitem que os agentes se conectem a CRMs, ERPs e sistemas de planta sem trabalho personalizado. O capital favorece equipes que movem métricas na margem (tempo de decisão, $/resposta, sucesso@K (porcentagem de resultados corretos no top-K)) e provam que podem escalar.

Até 2028: a mudança de infraestrutura.

A estrutura de mercado se bifurca:

— Concentração de alto nível: um punhado de empresas de IA de primeira linha formam super-conglomerados em torno da computação, dados e (em alguns casos) quântica – possuindo as camadas de capital mais pesadas.

— Vencedores viáveis de médio porte/SMB: especialistas em IA com implementações disciplinadas e sem erros em fluxos de trabalho concretos – onde a evidência, a repetibilidade e a economia unitária são óbvias. Os compradores preferem sistemas que mostrem auditabilidade à primeira vista; em setores sensíveis, as pegadas soberanas/on-prem se tornam requisitos rotineiros.

A IA recua para a plataforma – uma opção como armazenamento ou filas, não um projeto. Os orçamentos fluem para operações e controle: SLAs, telemetria, resposta a incidentes, aplicação de políticas.

Riscos-chave – o que poderia tirar uma empresa do mercado

1) Falhas de confiança (os "matadores" rápidos).

Confiança excessiva em modelos, sub-verificação de saídas e "AI washing" erodem a credibilidade rapidamente. Um erro público ou uma afirmação enganosa pode fechar portas com clientes e reguladores. Mitigar: pontos de verificação humanos em ações de risco, evidências/citações por padrão, divulgações em linguagem clara.

2) Exposição e segurança de dados.

Vazamentos de contexto via logs, caches ou injeção de prompts; junções de API descuidadas; retenção pouco clara. Uma única violação pode ser existencial. Mitigar: acesso com privilégios mínimos, isolamento de contexto, red-teaming, higiene de segredos, políticas claras de retenção.

3) Colapso da economia unitária.

Custos invisíveis de observabilidade, avaliações e retrabalho aumentam exponencialmente; casos de uso de contexto longo e em tempo real disparam os gastos; a latência não atende aos SLAs. Mitigar: custo/latência por resposta em dashboards, roteamento e cache de modelos, contextos delimitados, "kill-switches" para trabalhos descontrolados.

4) Bloqueio e fragilidade do fornecedor.

A dependência excessiva de um único modelo/fornecedor o deixa exposto a interrupções, mudanças de política ou alterações de preço. Mitigar: abstração multi-modelo, prompts/avaliações exportáveis, cláusulas de saída de contrato.

5) Conformidade e responsabilidade.

Regras do setor (PII (informações de identificação pessoal), propriedade intelectual, auditabilidade) mais a atenção do regulador a alegações enganosas. Mitigar: fluxos de dados mapeados, trilhas de auditoria, avaliações documentadas, aprovação jurídica da linguagem de marketing.

6) Gargalos estruturais.

Poder, chips e fornecimento de dados limpos podem limitar o crescimento ou encalhar o CAPEX à medida que as gerações de tecnologia mudam. Mitigar: planos de capacidade faseados, gestão de dados e limites conservadores de ROI em grandes construções.

Rumo à inteligência híbrida

Está acontecendo, com ou sem a nossa permissão. As máquinas assumirão muito mais trabalho – ordens de magnitude mais – do que já o fazem. Isso não significa um confronto homem versus máquina em um horizonte de médio prazo realista. Significa que nossas decisões, projetos e serviços serão cada vez mais produzidos por híbridos: pessoas, modelos e sistemas de dados trabalhando como um único tecido.

Pense na inteligência híbrida como uma nuvem de cognição compartilhada. Os algoritmos contribuem com velocidade e recuperação; os humanos adicionam julgamento, valores e contexto; os sistemas corporativos fornecem os registros; os governos estabelecem as regras – elegantemente atrasados. Organizações que permanecem conectadas a este tecido – onde a inteligência híbrida pode ler as fontes certas, agir nos sistemas certos e mostrar seu trabalho – simplesmente se moverão mais rápido e cometerão menos erros evitáveis. Também esperamos que os sistemas de IA agêntica executem o ciclo científico/P&D completo – desde a proposição de hipóteses e o design de experimentos até a execução de análises e a elaboração de submissões – enquanto um pesquisador principal humano os direciona para as perguntas certas.

A inteligência híbrida é uma divisão do trabalho. Aqueles que permanecerem desconectados se sentirão lentos – uma mula em uma rodovia: maior tempo de decisão, jornadas de cliente mais fracas, operações frágeis. A forma que perdura após a bolha é simples: deixe os modelos fazerem o que são bons, mantenha os humanos onde o julgamento importa e conecte os dois através de sistemas que preservem as evidências.

Em um futuro previsível, as interfaces "engrossarão" o tecido. Dispositivos vestíveis e áudio ambiente transformarão reuniões e trabalho de campo em contexto utilizável; prompts leves estarão dentro das ferramentas onde o trabalho já acontece. No horizonte, interfaces neurais poderiam abrir um link de alta largura de banda entre sistemas de IA e a intenção humana.

A última milha: como se preparar – e como o “híbrido” já se parece

Trabalhem juntos, desde o início.

Comecem construindo equipes mistas – humanos e agentes no mesmo ciclo. Peçam à IA para pesquisar – e depois para verificar a si mesma e à equipe. Ensinem as pessoas a colaborar com a IA, a aprender com ela e a ensiná-la de volta (pair-ops, playbooks).

Mantenham-se atentos a modelos, regras e preços.

Acompanhe as principais atualizações de modelos e as movimentações regulatórias (regras locais de privacidade e setor). Fique de olho nos preços para não gastar demais em tokens e contexto. Hábito simples: um "one-pager" mensal com "o que mudou", as diferenças de custo e o impacto em seus fluxos de trabalho.

Pratiquem a higiene de dados.

Inventariem e aprovem suas fontes. Decidam quais são 'ouro', quem as mantém e com que frequência são atualizadas. Removam ou mascarem PII (informações de identificação pessoal). Estabeleçam regras de retenção. Controlem caches e camadas temporárias para que o contexto sensível não vaze para os logs.

Insiram o fator humano em pontos de decisão.

Definam os pontos de verificação, funções e protocolos de escalonamento para etapas de alto risco. Façam com que as aprovações sejam parte do artefato (quem assinou, quando, com base em qual evidência).

Auditem o acesso e adicionem telemetria.

Se você não consegue ver, não consegue escalar. Conheça o fluxo de trabalho. Descubra quem pode ler/escrever quais fontes, o que está sendo registrado e quem aprovou. Implemente rastros de ponta a ponta. Acompanhe as versões do modelo, o consumo de tokens e a latência por resposta.

Escolham sua "pegada": nuvem ou soberana.

Onde a política ou os contratos de clientes exigirem, planeje implantações no local. Caso contrário, seja explícito sobre por que a nuvem é aceitável e como você sairá, se necessário.

Experimente a colaboração híbrida

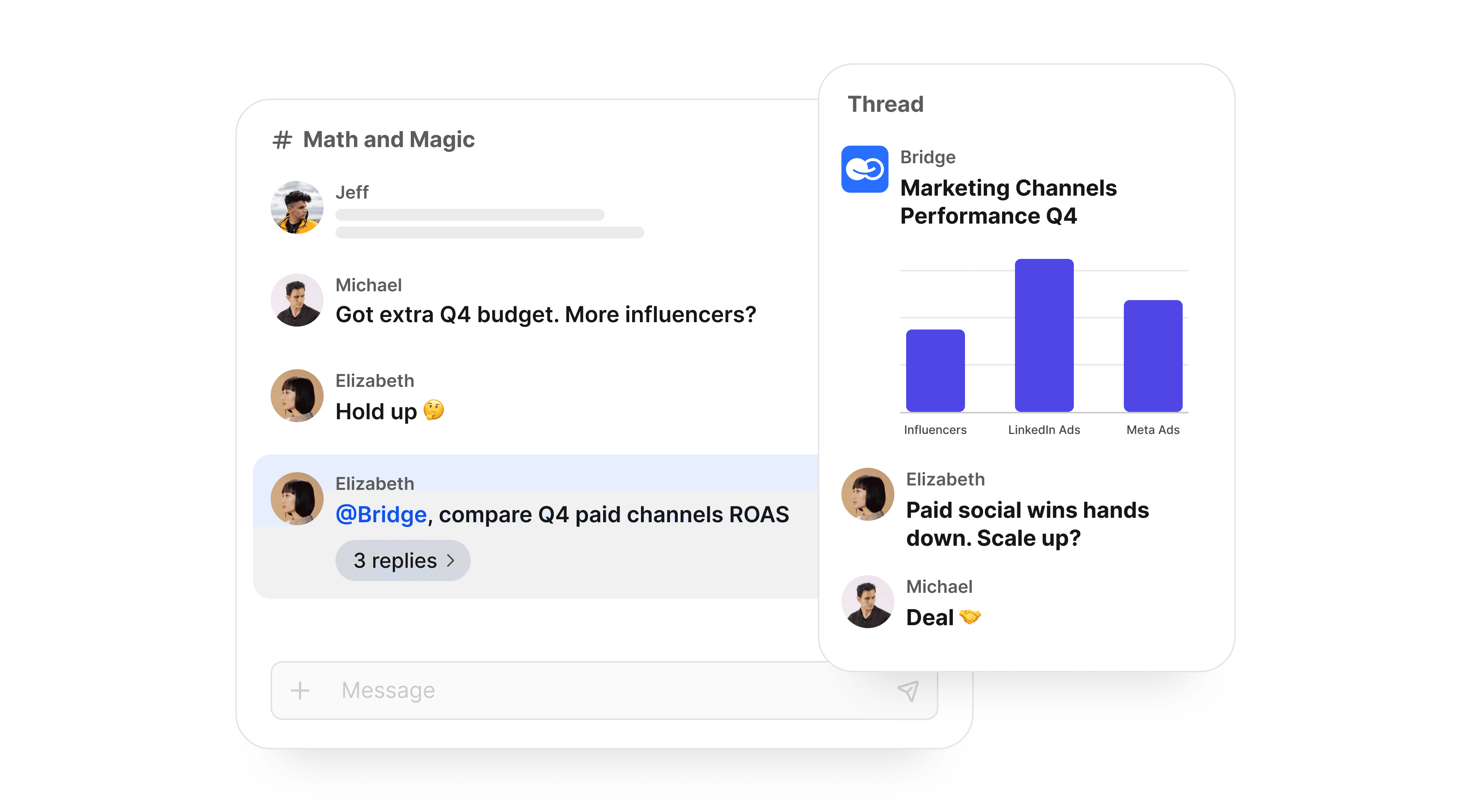

A mudança já é visível em ferramentas que vivem ao lado do trabalho, não fora dele. Um padrão típico:

- Os fluxos agênticos extraem conhecimento aprovado, elaboram um plano e param em pontos de verificação HITL (Human-In-The-Loop) para julgamento.

- O RAG em dados privados fundamenta as respostas em citações de seus documentos, tíquetes e logs.

- A orquestração e a telemetria rastreiam cada etapa, com custo/latência por resposta em um painel e prompts/políticas versionadas para auditoria.

- A integração do sistema significa que a saída não é uma transcrição – é um tíquete arquivado, um registro atualizado, um fluxo de trabalho avançado.

Esses princípios já moldam uma nova classe de plataformas colaborativas.

BridgeApp é uma delas. Os agentes lá não "conversam por esporte": a IA lida com tarefas rotineiras, as decisões acontecem mais rápido, as transferências são menos frequentes e a lógica é observável. Você pode mostrar os resultados a auditores, clientes e à sua própria equipe.

Veja como o BridgeApp pode impulsionar mudanças de estado reais em seus negócios.