BlogInsights da indústria

Um Guia Completo do Protocolo de Contexto do Modelo (MCP): Arquitetura, Integração e Melhores Práticas

Equipe BridgeApp

7 min de leitura

O Que É MCP (Protocolo de Contexto do Modelo)?

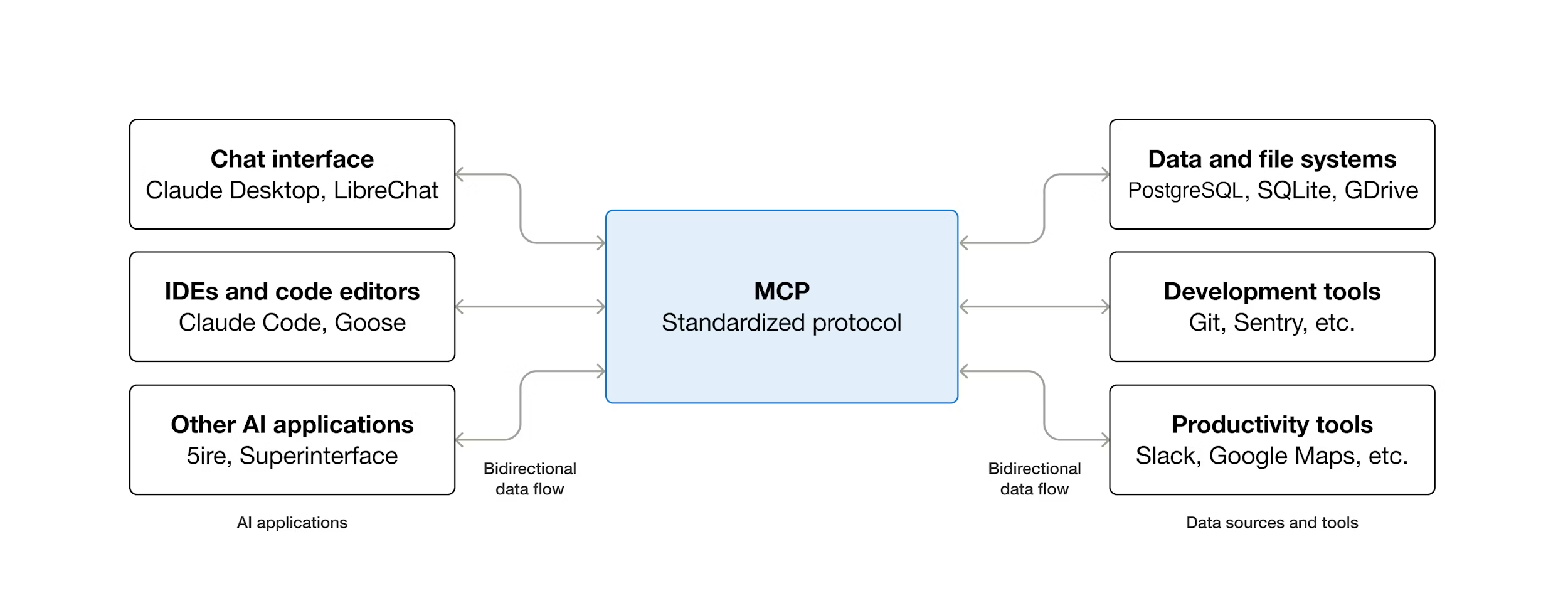

O Protocolo de Contexto do Modelo (MCP) é um padrão aberto introduzido pela Anthropic em novembro de 2024 que define como os modelos de IA se conectam de forma segura com ferramentas externas, bancos de dados e serviços.

Pense no MCP como o USB-C das integrações de IA: um padrão universal que permite que qualquer aplicação de IA se conecte a qualquer fonte de dados ou ferramenta — sem adaptadores personalizados para cada par.

Grandes modelos de linguagem (LLMs) são altamente capazes em raciocínio e geração de texto, mas possuem uma limitação fundamental: eles não conseguem acessar dados do mundo real ou invocar ferramentas externas por conta própria. O MCP foi projetado para resolver exatamente este problema.

Ao contrário de um simples wrapper de API, um servidor MCP faz muito mais do que traduzir chamadas HTTP. Ele gerencia o estado da sessão, impõe controle de acesso, expõe um menu estruturado de capacidades e garante que os modelos de IA recebam informações precisas, oportunas e contextualmente relevantes.

Definição rápida: MCP é um protocolo cliente-servidor construído sobre JSON-RPC 2.0 que permite que aplicações de IA descubram e chamem ferramentas externas e fontes de dados através de uma única interface padronizada.

Arquitetura e Componentes do MCP

Em sua essência, o MCP define uma arquitetura cliente-servidor construída sobre JSON-RPC 2.0 — um padrão de chamada de procedimento remoto aberto e leve.

Este design resolve o clássico problema N×M: conectar N diferentes modelos de IA a M diferentes fontes de dados sem escrever N×M adaptadores personalizados.

A arquitetura MCP consiste em quatro componentes primários:

- Host MCP

- Cliente MCP

- Servidor MCP

- Camada de Transporte

Camada de Transporte

Servidores MCP podem se comunicar:

- Localmente via stdio — para implantações na mesma máquina

- Remotamente via HTTP (HTTP Transmissível) — para sistemas distribuídos

Conexões remotas exigem HTTPS com autenticação adequada. Conexões locais são adequadas para ambientes de desenvolvimento ou implantações rigidamente controladas.

Host MCP

O host MCP é o ambiente de aplicação de nível superior onde um assistente de IA opera. Exemplos incluem:

- IDEs

- Interfaces de chat

- Frameworks de agentes autônomos

O host é responsável por:

- Descobrir servidores MCP disponíveis

- Orquestrar solicitações para esses servidores

- Exibir prompts de permissão para operações sensíveis

No início da sessão, o host realiza um handshake de descoberta para aprender quais ferramentas, recursos e prompts estão disponíveis. Para ações de risco (por exemplo, escrever em um sistema de arquivos), o host impõe confirmação e supervisão humana.

Cliente MCP

O cliente MCP reside dentro do host e mantém uma conexão um-para-um com um único servidor MCP.

Suas responsabilidades incluem:

- Traduzir a intenção de alto nível em solicitações JSON-RPC

- Registrar capacidades do servidor

- Normalizar e retransmitir respostas de volta ao host

No início da sessão, o cliente realiza o registro de capacidades, consultando o servidor pelos métodos disponíveis e armazenando-os em cache para uso em tempo de inferência.

SDKs Suportados

SDKs oficiais estão disponíveis para:

- Python

- TypeScript

- Java

- Kotlin

- C#

Exemplo: Inicializando um Cliente MCP em Python

from mcp import ClientSession, StdioServerParameters

from mcp.client.stdio import stdio_client

server_params = StdioServerParameters(

command="python",

args=["my_mcp_server.py"]

)

async with stdio_client(server_params) as (read, write):

async with ClientSession(read, write) as session:

await session.initialize()

tools = await session.list_tools()

print(tools)

Servidor MCP

O servidor MCP é o serviço externo que fornece dados, contexto ou capacidades ao LLM. Ele atua entre o modelo de IA e sistemas subjacentes como:

- Bancos de dados

- APIs

- Plataformas SaaS

- Sistemas de arquivos

Capacidades Essenciais Expostas pelos Servidores MCP

- Ferramentas — ações executáveis (por exemplo, consultas SQL, issues do GitHub)

- Recursos — dados somente leitura (esquemas, arquivos, artigos de KB)

- Prompts — modelos de instrução predefinidos

Exemplo: Definindo uma Ferramenta em um Servidor MCP

from mcp.server import Server

from mcp.server.models import InitializationOptions

import mcp.types as types

server = Server("my-server")

@server.list_tools()

async def list_tools() -> list[types.Tool]:

return [

types.Tool(

name="get_sales_summary",

description="Fetch last month's sales data from the database",

inputSchema={

"type": "object",

"properties": {

"month": {

"type": "string",

"description": "Month in YYYY-MM format"

}

},

"required": ["month"]

}

)

]

MCP vs API vs Chamada de Função

| Característica | API Tradicional | Chamada de Função | MCP |

|---|---|---|---|

| Padronização | Personalizada por serviço | Específica do modelo | Universal |

| Descoberta | Documentos manuais | Esquema estático | Tempo de execução |

| Suporte a múltiplas ferramentas | Personalizado por N×M | Limitado | Integrado |

| Sessão/estado | Lado do aplicativo | Nenhum | Lado do servidor |

| Padrão aberto | Não | Não | Sim |

| Aderência ao fornecedor (Vendor lock-in) | Alto | Médio | Baixo |

Distinção chave:

A chamada de função invoca uma função dentro de uma aplicação. O MCP permite que qualquer aplicativo de IA compatível com MCP descubra e chame qualquer servidor MCP dinamicamente em tempo de execução.

Controle de Acesso e Segurança

A segurança é fundamental nas implantações de MCP.

As melhores práticas incluem:

- HTTPS para servidores remotos

- Chaves de API, tokens ou OAuth para autenticação

- Permissões de escopo por método de ferramenta (privilégio mínimo)

Para operações de risco (escritas, exclusões, mensagens de saída), os servidores MCP devem exigir prompts de permissão explícita, garantindo supervisão humana mesmo em fluxos de trabalho automatizados.

MCP Dentro do BridgeApp: Transformando Seu Workspace em um Sistema Agente

Com suporte nativo ao MCP, o BridgeApp se torna um ambiente totalmente interoperável onde agentes de IA, ferramentas e dados operam dentro de uma única camada de contexto. Agora é possível integrar qualquer uma de suas ferramentas via MCP para construir fluxos de trabalho complexos alimentados por nosso motor de IA. Conecte suas ferramentas existentes uma vez. A partir desse ponto, lidamos com os fluxos de trabalho complexos e de várias etapas que costumavam consumir o tempo de sua equipe: rotear solicitações, atualizar registros, acionar ações entre sistemas e manter cada departamento sincronizado, automaticamente.

Como você conecta um servidor MCP externo no BridgeApp?

A resposta curta: está em Agentes → Servidores MCP, e leva cerca de dois minutos.

A resposta mais longa começa com o que realmente acontece quando você se conecta. Você cola o URL do servidor MCP — geralmente encontrado na documentação do provedor — escolhe o tipo de autenticação que o servidor exige, e o BridgeApp faz o resto. Ele busca automaticamente todos os métodos disponíveis desse servidor e os lista com descrições. Você vê exatamente o que a integração pode fazer antes de construir qualquer coisa com ela.

As opções de autenticação cobrem a maioria das configurações comuns: sem autenticação, código de autorização, credenciais de cliente, token de workspace, token de usuário ou código de autenticação de workspace — dependendo do que seu provedor suporta.

Para concretizar: conectamos o Ahrefs para nossa equipe de marketing. Criamos um agente de análise. Demos a ele acesso ao MCP do Ahrefs. O agente agora puxa dados de busca em tempo real e responde a perguntas de SEO diretamente dentro do BridgeApp, no mesmo chat onde o resto do trabalho acontece.

Integrações MCP com Sistemas de IA e Agentes de IA

O MCP permite que agentes de IA:

- Ler arquivos

- Consultar bancos de dados

- Chamar APIs externas

- Escrever resultados de volta aos sistemas de origem

Tudo dentro de um único fluxo de trabalho, sem código de integração personalizado.

Clientes MCP comuns incluem:

- Assistentes de codificação

- Frameworks de agentes autônomos

- Chatbots empresariais

- Pipelines RAG

Fluxo Típico de Integração de Agentes

- Registrar capacidades do servidor MCP

- Fornecer metadados ricos para cada ferramenta

- Invocar ferramentas via cliente MCP durante a inferência

Metadados melhores melhoram a confiabilidade da seleção de ferramentas.

Chamada de Função e IA Agente

O MCP formaliza e estende a chamada de função, expondo ferramentas através de uma interface unificada e descoberta.

Isso permite um verdadeiro comportamento de agente:

- Ler a intenção do usuário

- Selecionar ferramentas

- Executar ações

- Decidir os próximos passos autonomamente

O MCP também suporta elicitação — solicitando entradas ausentes antes da execução — e mantém a memória da sessão entre várias chamadas de ferramentas.

Padrões de Integração MCP

Servidores de Banco de Dados

Expor métodos de consulta seguros e parametrizados em vez de SQL bruto.

Servidores de Sistema de Arquivos

Fornecer acesso de leitura/escrita com escopo usando diretórios raiz.

Integrações SaaS

Lidar com autenticação, limitação de taxa e normalização de dados internamente, enquanto expõe uma interface limpa ao modelo de IA.

Melhores Práticas para Servidores MCP

- Documentação clara de JSON Schema

- Códigos de erro estruturados

- Validação de entrada rigorosa

- Limitação de taxa

- Composição dinâmica e design modular

Estas práticas permitem que os servidores MCP escalem em sistemas complexos e multiagente.

Fontes de Dados e Dados Externos

Cada fonte de dados deve ser registrada com:

- Um esquema de resposta claro

- Saídas validadas

- Acesso com escopo (por exemplo, raízes de sistemas de arquivos)

Observabilidade e Monitoramento

Monitorar:

- Percentis de latência por ferramenta

- Taxas de erro

- Sessões ativas e acertos de cache

- Taxa de transferência sob carga

O rastreamento de ponta a ponta é crítico para depurar o comportamento do agente.

Implantação: Servidores MCP Locais vs Remotos

Implantação Local

Melhor para ferramentas de desenvolvedor e ambientes controlados.

Implantação Remota

Melhor para sistemas corporativos e plataformas multiusuário.

Considerações de produção:

- Autoescalabilidade

- Cache

- Tolerância a falhas e redundância

FAQ: Protocolo de Contexto do Modelo

O que é o Protocolo de Contexto do Modelo (MCP) em termos simples?

O Protocolo de Contexto do Modelo (MCP) é uma forma aberta e padronizada para modelos de IA e agentes de IA interagirem com segurança com ferramentas externas, bancos de dados, APIs e serviços.

Em termos simples, o MCP atua como uma ponte universal entre a IA e o mundo real. Em vez de codificar integrações para cada ferramenta, o MCP permite que as aplicações de IA descubram, compreendam e usem capacidades externas dinamicamente através de um único protocolo. Isso torna os sistemas de IA mais flexíveis, escaláveis e confiáveis.

Quem criou o MCP e por que foi introduzido?

O MCP foi introduzido pela Anthropic em novembro de 2024 como um padrão aberto.

A motivação por trás do MCP foi resolver um problema crescente na engenharia de IA: os sistemas modernos de IA precisam de acesso a dados e ferramentas em tempo real, mas as abordagens existentes (APIs personalizadas e chamada de função) não escalam bem. O MCP foi projetado para:

- Reduzir a complexidade da integração

- Eliminar a aderência ao fornecedor

- Habilitar fluxos de trabalho de IA agente seguros

- Padronizar a comunicação IA-para-ferramenta

Embora criado pela Anthropic, o MCP não é proprietário e é destinado à ampla adoção da indústria.

O MCP é de código aberto e agnóstico de fornecedor?

Sim. O MCP é de código aberto e agnóstico de fornecedor.

- A especificação do protocolo é pública

- As implementações de referência são mantidas pela comunidade

- Qualquer empresa ou indivíduo pode implementar servidores ou clientes MCP

Essa abertura é crítica para evitar a fragmentação do ecossistema e garantir que o MCP possa ser usado em diferentes modelos de IA, frameworks e provedores de infraestrutura.

Como o MCP é diferente de uma API tradicional?

Uma API tradicional exige que os desenvolvedores escrevam código de integração personalizado para cada cliente e cada caso de uso. Isso rapidamente leva a sistemas frágeis e esforço duplicado.

O MCP difere em várias maneiras principais:

- Descoberta dinâmica: modelos de IA podem descobrir ferramentas em tempo de execução

- Interface padronizada: Sem adaptadores personalizados por integração

- Contexto gerenciado pelo servidor: Estado e permissões são tratados centralmente

- Design focado em IA: Esquemas e metadados são otimizados para o raciocínio de LLMs

Em resumo, as APIs são construídas para humanos e aplicações. O MCP é construído para sistemas de IA.

Qual é a diferença entre MCP e chamada de função de LLM?

A chamada de função permite que um LLM invoque funções predefinidas dentro de uma única aplicação. Essas funções são geralmente codificadas de forma rígida e fortemente acopladas ao aplicativo.

O MCP vai muito além:

- As ferramentas são expostas por servidores externos, não embutidas no aplicativo

- As capacidades são descobertas dinamicamente em tempo de execução

- O MCP funciona entre fornecedores, linguagens e plataformas

- O estado da sessão e as permissões são gerenciados no lado do servidor

A chamada de função é um recurso. O MCP é um protocolo de nível de ecossistema.

O MCP pode funcionar com qualquer modelo de IA ou LLM?

Sim. O MCP é agnóstico ao modelo.

Funciona com:

- Claude

- Modelos GPT

- Gemini

- LLMs de código aberto

- Qualquer modelo que suporte o uso de ferramentas ou saída estruturada

O MCP não depende de uma arquitetura de modelo específica. Enquanto um sistema de IA puder interpretar esquemas de ferramentas e produzir chamadas estruturadas, ele poderá usar o MCP.

Quais problemas o MCP resolve para agentes de IA?

O MCP permite que os agentes de IA vão além da geração de texto estática e se tornem sistemas capazes de ação.

Principais problemas que o MCP resolve:

- Acesso seguro a dados em tempo real

- Invocação confiável de ferramentas

- Memória de sessão persistente

- Execução permissionada de ações

- Orquestração escalável de múltiplas ferramentas

Isso torna o MCP fundamental para a IA agente, onde os sistemas planejam, agem, observam resultados e iteram autonomamente.

O que são ferramentas, recursos e prompts do MCP?

Os servidores MCP expõem três tipos principais de capacidade:

- Ferramentas: Ações executáveis (por exemplo, consultas de banco de dados, escritas em arquivos, chamadas de API)

- Recursos: Fontes de dados somente leitura (arquivos, esquemas, documentos)

- Prompts: Modelos de instrução predefinidos para um comportamento de modelo consistente

Essa separação melhora a segurança, clareza e qualidade do raciocínio para LLMs.

Como o MCP lida com segurança e controle de acesso?

A segurança é um princípio central de design do MCP.

As melhores práticas incluem:

- HTTPS para servidores MCP remotos

- Chaves de API, tokens ou autenticação OAuth

- Permissões granulares por método de ferramenta

- Aprovação explícita do usuário para operações de risco

O MCP segue um modelo de privilégio mínimo, garantindo que os sistemas de IA acessem apenas o que lhes é explicitamente permitido usar.

O MCP pode manter contexto e memória entre sessões?

Sim. Os servidores MCP podem manter estado e memória em nível de sessão.

Isso permite:

- Fluxos de trabalho multi-etapa

- Tarefas de agente de longa duração

- Persistência de contexto em múltiplas chamadas de ferramentas

O gerenciamento de sessão é tratado no lado do servidor, tornando os agentes de IA mais confiáveis e menos frágeis.

Como o MCP reduz as alucinações em sistemas de IA?

O MCP reduz as alucinações ao:

- Impor esquemas estruturados para entradas e saídas

- Fornecer contratos explícitos de ferramentas e dados

- Validar respostas antes de retorná-las ao modelo

- Limitar o acesso a recursos bem definidos

Ao restringir o que o modelo pode ver e fazer, o MCP melhora a fundamentação factual e a confiabilidade da execução.

Quais são os casos de uso comuns para o MCP?

Casos de uso típicos do MCP incluem:

- Assistentes de codificação de IA

- Chatbots empresariais

- Agentes de IA autônomos

- Pipelines RAG com dados em tempo real

- Ferramentas internas para desenvolvedores

- Sistemas de automação de fluxo de trabalho

Em qualquer lugar onde a IA precise de acesso seguro e estruturado a sistemas externos, o MCP é aplicável.

O MCP é adequado para sistemas corporativos e de produção?

Sim. O MCP é projetado para implantações de nível de produção.

Recursos empresariais incluem:

- Autenticação e autorização

- Observabilidade e rastreamento

- Limitação de taxa e cotas

- Escalabilidade horizontal

- Tolerância a falhas

O MCP pode ser implantado localmente para ambientes sensíveis ou remotamente para plataformas em larga escala.

Como o MCP ajuda com escalabilidade e manutenção?

O MCP reduz drasticamente a sobrecarga de integração:

- Um servidor MCP pode atender muitos clientes de IA

- Novas ferramentas podem ser adicionadas sem alterações no lado do cliente

- As integrações são modulares e componíveis

Isso reduz os custos de manutenção de longo prazo e permite uma iteração mais rápida à medida que os sistemas de IA evoluem.

O MCP está se tornando um padrão da indústria?

O MCP está emergindo rapidamente como o padrão default para conectividade entre IA e ferramentas.

Já foi adotado por:

- Ambientes de desenvolvimento de IA

- Frameworks de agentes

- Assistentes de codificação

À medida que os sistemas de IA se tornam mais agentes e orientados à ação, protocolos padronizados como o MCP são cada vez mais necessários.

Desenvolvedores e equipes deveriam aprender MCP agora?

Sim. Equipes que entendem o MCP cedo ganham uma vantagem estratégica.

O conhecimento de MCP ajuda com:

- Construção de plataformas de IA escaláveis

- Projeto de fluxos de trabalho de agentes seguros

- Evitar a aderência ao fornecedor

- Preparar arquiteturas de IA para o futuro

À medida que a IA passa da geração para a execução, o MCP se torna uma infraestrutura fundamental.