БлогInsights da indústria

Um Guia Completo para o Protocolo de Contexto do Modelo (MCP): Arquitetura, Integração e Melhores Práticas

Equipe BridgeApp

7 мин чтения

O Que é MCP (Protocolo de Contexto do Modelo)?

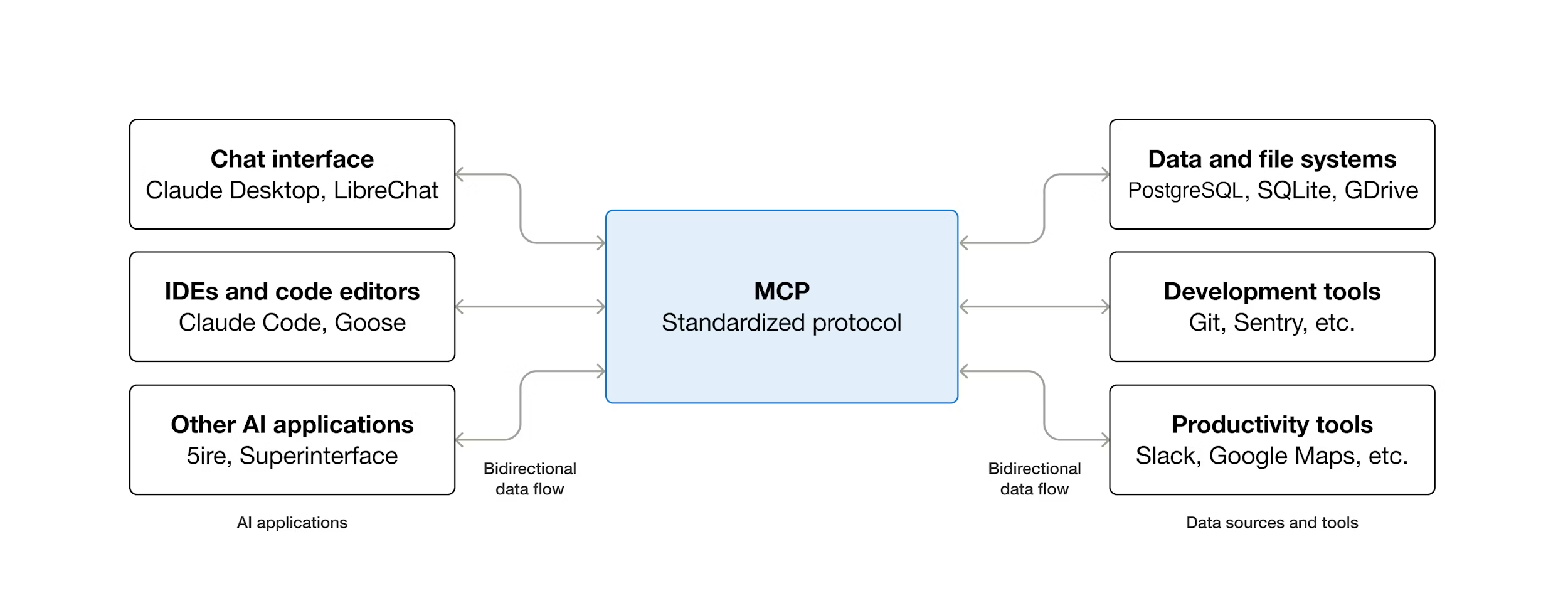

O Protocolo de Contexto do Modelo (MCP) é um padrão aberto introduzido pela Anthropic em novembro de 2024 que define como os modelos de IA se conectam de forma segura com ferramentas externas, bancos de dados e serviços.

Pense no MCP como o USB-C das integrações de IA: um padrão universal que permite que qualquer aplicação de IA se conecte a qualquer fonte de dados ou ferramenta — sem adaptadores personalizados para cada par.

Grandes modelos de linguagem (LLMs) são altamente capazes em raciocínio e geração de texto, mas têm uma limitação fundamental: eles não conseguem acessar dados do mundo real ou invocar ferramentas externas por conta própria. O MCP foi projetado para resolver exatamente esse problema.

Ao contrário de um simples invólucro de API, um servidor MCP faz muito mais do que traduzir chamadas HTTP. Ele gerencia o estado da sessão, impõe o controle de acesso, expõe um menu estruturado de capacidades e garante que os modelos de IA recebam informações precisas, oportunas e contextualmente relevantes.

Definição rápida: MCP é um protocolo cliente-servidor construído sobre JSON-RPC 2.0 que permite que aplicações de IA descubram e chamem ferramentas e fontes de dados externas através de uma interface única e padronizada.

Arquitetura e Componentes do MCP

Em sua essência, o MCP define uma arquitetura cliente-servidor construída sobre JSON-RPC 2.0 — um padrão de chamada de procedimento remoto aberto e leve.

Este design resolve o clássico problema N×M: conectar N modelos de IA diferentes a M fontes de dados diferentes sem escrever N×M adaptadores personalizados.

A arquitetura MCP consiste em quatro componentes primários:

- Host MCP

- Cliente MCP

- Servidor MCP

- Camada de Transporte

Camada de Transporte

Os servidores MCP podem se comunicar:

- Localmente via stdio — para implantações na mesma máquina

- Remotamente via HTTP (Streamable HTTP) — para sistemas distribuídos

Conexões remotas exigem HTTPS com autenticação adequada. Conexões locais são adequadas para ambientes de desenvolvimento ou implantações estritamente controladas.

Host MCP

O host MCP é o ambiente de aplicação de nível superior onde um assistente de IA opera. Exemplos incluem:

- IDEs

- Interfaces de chat

- Frameworks de agente autônomo

O host é responsável por:

- Descobrir servidores MCP disponíveis

- Orquestrar solicitações para esses servidores

- Exibir prompts de permissão para operações sensíveis

Na inicialização da sessão, o host realiza um handshake de descoberta para saber quais ferramentas, recursos e prompts estão disponíveis. Para ações arriscadas (por exemplo, gravar em um sistema de arquivos), o host impõe confirmação e supervisão humana.

Cliente MCP

O cliente MCP reside dentro do host e mantém uma conexão um-para-um com um único servidor MCP.

Suas responsabilidades incluem:

- Traduzir intenções de alto nível em requisições JSON-RPC

- Registrar capacidades do servidor

- Normalizar e retransmitir respostas de volta ao host

Na inicialização da sessão, o cliente realiza o registro de capacidade, consultando o servidor sobre os métodos disponíveis e armazenando-os em cache para uso durante a inferência.

SDKs Suportados

SDKs oficiais estão disponíveis para:

- Python

- TypeScript

- Java

- Kotlin

- C#

Exemplo: Inicializando um Cliente MCP em Python

from mcp import ClientSession, StdioServerParameters

from mcp.client.stdio import stdio_client

server_params = StdioServerParameters(

command="python",

args=["my_mcp_server.py"]

)

async with stdio_client(server_params) as (read, write):

async with ClientSession(read, write) as session:

await session.initialize()

tools = await session.list_tools()

print(tools)

Servidor MCP

O servidor MCP é o serviço externo que fornece dados, contexto ou capacidades para o LLM. Ele se situa entre o modelo de IA e os sistemas subjacentes, como:

- Bancos de dados

- APIs

- Plataformas SaaS

- Sistemas de arquivos

Capacidades Essenciais Expostas pelos Servidores MCP

- Ferramentas — ações executáveis (ex: consultas SQL, problemas do GitHub)

- Recursos — dados somente leitura (esquemas, arquivos, artigos de base de conhecimento)

- Prompts — modelos de instrução predefinidos

Exemplo: Definindo uma Ferramenta em um Servidor MCP

from mcp.server import Server

from mcp.server.models import InitializationOptions

import mcp.types as types

server = Server("my-server")

@server.list_tools()

async def list_tools() -> list[types.Tool]:

return [

types.Tool(

name="get_sales_summary",

description="Fetch last month's sales data from the database",

inputSchema={

"type": "object",

"properties": {

"month": {

"type": "string",

"description": "Month in YYYY-MM format"

}

},

"required": ["month"]

}

)

]

MCP vs API vs Chamada de Função

| Característica | API Tradicional | Chamada de Função | MCP |

|---|---|---|---|

| Padronização | Personalizada por serviço | Específica do modelo | Universal |

| Descoberta | Docs manuais | Esquema estático | Tempo de execução |

| Suporte a várias ferramentas | Personalizado por N×M | Limitado | Integrado |

| Sessão/estado | Lado da aplicação | Nenhum | Lado do servidor |

| Padrão aberto | Não | Não | Sim |

| Bloqueio de fornecedor | Alto | Médio | Baixo |

Distinção chave:

A chamada de função invoca uma função dentro de uma aplicação. O MCP permite que qualquer aplicação de IA compatível com MCP descubra e chame qualquer servidor MCP dinamicamente em tempo de execução.

Controle de Acesso e Segurança

A segurança é fundamental nas implantações de MCP.

As melhores práticas incluem:

- HTTPS para servidores remotos

- Chaves de API, tokens ou OAuth para autenticação

- Permissões com escopo por método de ferramenta (privilégio mínimo)

Para operações de risco (escritas, exclusões, mensagens de saída), os servidores MCP devem exigir prompts de permissão explícitos, garantindo a supervisão humana mesmo em fluxos de trabalho automatizados.

Integrações do MCP com Sistemas e Agentes de IA

O MCP permite que os agentes de IA:

- Leiam arquivos

- Consultem bancos de dados

- Chamem APIs externas

- Gravem resultados de volta aos sistemas de origem

Tudo dentro de um único fluxo de trabalho, sem código de integração personalizado.

Clientes MCP comuns incluem:

- Assistentes de codificação

- Frameworks de agente autônomo

- Chatbots empresariais

- Pipelines RAG

Fluxo Típico de Integração de Agentes

- Registrar as capacidades do servidor MCP

- Fornecer metadados ricos para cada ferramenta

- Invocar ferramentas via cliente MCP durante a inferência

Melhores metadados aumentam a confiabilidade da seleção de ferramentas.

Chamada de Função e IA Agêntica

O MCP formaliza e estende a chamada de função, expondo ferramentas através de uma interface unificada e descoberta.

Isso permite um verdadeiro comportamento agêntico:

- Ler a intenção do usuário

- Selecionar ferramentas

- Executar ações

- Decidir os próximos passos autonomamente

O MCP também suporta a elicitação — solicitar entradas ausentes antes da execução — e mantém a memória de sessão em várias chamadas de ferramentas.

Padrões de Integração MCP

Servidores de Banco de Dados

Expor métodos de consulta seguros e parametrizados em vez de SQL puro.

Servidores de Sistema de Arquivos

Fornecer acesso de leitura/escrita com escopo usando diretórios raiz.

Integrações SaaS

Lidar com autenticação, limitação de taxa e normalização de dados internamente, enquanto expõe uma interface limpa ao modelo de IA.

Melhores Práticas para Servidores MCP

- Documentação clara do JSON Schema

- Códigos de erro estruturados

- Validação rigorosa de entrada

- Limitação de taxa

- Componibilidade dinâmica e design modular

Essas práticas permitem que os servidores MCP escalem em sistemas multiagentes complexos.

Fontes de Dados e Dados Externos

Cada fonte de dados deve ser registrada com:

- Um esquema de resposta claro

- Saídas validadas

- Acesso com escopo (ex: raízes do sistema de arquivos)

Isso reduz alucinações e impõe o menor privilégio.

Observabilidade e Monitoramento

Acompanhar:

- Percentis de latência por ferramenta

- Taxas de erro

- Sessões ativas e acertos de cache

- Vazão sob carga

O rastreamento de ponta a ponta é crítico para depurar o comportamento do agente.

Implantação: Servidores MCP Locais vs Remotos

Implantação Local

Melhor para ferramentas de desenvolvedor e ambientes controlados.

Implantação Remota

Melhor para sistemas empresariais e plataformas multiusuário.

Considerações para produção:

- Dimensionamento automático

- Cache

- Tolerância a falhas e redundância

FAQ: Protocolo de Contexto do Modelo

O que é o Protocolo de Contexto do Modelo (MCP) em termos simples?

O Protocolo de Contexto do Modelo (MCP) é uma forma aberta e padronizada para modelos e agentes de IA interagirem de forma segura com ferramentas externas, bancos de dados, APIs e serviços.

Em termos simples, o MCP atua como uma ponte universal entre a IA e o mundo real. Em vez de codificar integrações para cada ferramenta, o MCP permite que as aplicações de IA descubram, entendam e usem dinamicamente capacidades externas através de um único protocolo. Isso torna os sistemas de IA mais flexíveis, escaláveis e confiáveis.

Quem criou o MCP e por que ele foi introduzido?

O MCP foi introduzido pela Anthropic em novembro de 2024 como um padrão aberto.

A motivação por trás do MCP foi resolver um problema crescente na engenharia de IA: os sistemas de IA modernos precisam de acesso a dados e ferramentas em tempo real, mas as abordagens existentes (APIs personalizadas e chamada de função) não escalam bem. O MCP foi projetado para:

- Reduzir a complexidade da integração

- Eliminar o bloqueio de fornecedor

- Permitir fluxos de trabalho de IA agêntica seguros

- Padronizar a comunicação entre IA e ferramentas

Embora criado pela Anthropic, o MCP não é proprietário e destina-se a uma ampla adoção na indústria.

O MCP é de código aberto e neutro em relação ao fornecedor?

Sim. O MCP é tanto de código aberto quanto neutro em relação ao fornecedor.

- A especificação do protocolo é pública

- As implementações de referência são mantidas pela comunidade

- Qualquer empresa ou indivíduo pode implementar servidores ou clientes MCP

Essa abertura é crítica para evitar a fragmentação do ecossistema e garantir que o MCP possa ser usado em diferentes modelos de IA, frameworks e provedores de infraestrutura.

Como o MCP difere de uma API tradicional?

Uma API tradicional exige que os desenvolvedores escrevam código de integração personalizado para cada cliente e cada caso de uso. Isso leva rapidamente a sistemas frágeis e esforço duplicado.

O MCP difere de várias maneiras importantes:

- Descoberta dinâmica: os modelos de IA podem descobrir ferramentas em tempo de execução

- Interface padronizada: sem adaptadores personalizados por integração

- Contexto gerenciado pelo servidor: estado e permissões são tratados centralmente

- Design focado em IA: esquemas e metadados são otimizados para o raciocínio de LLMs

Em suma, as APIs são construídas para humanos e aplicações. O MCP é construído para sistemas de IA.

Qual é a diferença entre MCP e chamada de função de LLM?

A chamada de função permite que um LLM invoque funções predefinidas dentro de uma única aplicação. Essas funções geralmente são codificadas e rigidamente acopladas à aplicação.

O MCP vai muito além:

- As ferramentas são expostas por servidores externos, não incorporadas na aplicação

- As capacidades são descobertas dinamicamente em tempo de execução

- O MCP funciona em fornecedores, linguagens e plataformas

- O estado da sessão e as permissões são gerenciados no lado do servidor

A chamada de função é uma característica. O MCP é um protocolo de nível de ecossistema.

O MCP pode funcionar com qualquer modelo de IA ou LLM?

Sim. O MCP é agnóstico ao modelo.

Ele funciona com:

- Claude

- Modelos GPT

- Gemini

- LLMs de código aberto

- Qualquer modelo que suporte o uso de ferramentas ou saída estruturada

O MCP não depende de uma arquitetura de modelo específica. Contanto que um sistema de IA possa interpretar esquemas de ferramentas e produzir chamadas estruturadas, ele pode usar o MCP.

Quais problemas o MCP resolve para os agentes de IA?

O MCP permite que os agentes de IA vão além da geração de texto estática e se tornem sistemas capazes de agir.

Problemas chave que o MCP resolve:

- Acesso seguro a dados em tempo real

- Invocação confiável de ferramentas

- Memória de sessão persistente

- Execução autorizada de ações

- Orquestração escalável de múltiplas ferramentas

Isso torna o MCP fundamental para a IA agêntica, onde os sistemas planejam, agem, observam resultados e iteram autonomamente.

O que são ferramentas, recursos e prompts do MCP?

Os servidores MCP expõem três tipos principais de capacidade:

- Ferramentas: Ações executáveis (ex: consultas a bancos de dados, gravação de arquivos, chamadas de API)

- Recursos: Fontes de dados somente leitura (arquivos, esquemas, artigos da base de conhecimento)

- Prompts: Modelos de instrução predefinidos para comportamento consistente do modelo

Essa separação melhora a segurança, a clareza e a qualidade do raciocínio para LLMs.

Como o MCP lida com segurança e controle de acesso?

A segurança é um princípio central de design do MCP.

As melhores práticas incluem:

- HTTPS para servidores MCP remotos

- Chaves de API, tokens ou autenticação OAuth

- Permissões detalhadas por método de ferramenta

- Aprovação explícita do usuário para operações de risco

O MCP segue um modelo de privilégio mínimo, garantindo que os sistemas de IA acessem apenas o que lhes é explicitamente permitido usar.

O MCP pode manter o contexto e a memória entre as sessões?

Sim. Os servidores MCP podem manter o estado e a memória em nível de sessão.

Isso permite:

- Fluxos de trabalho de várias etapas

- Tarefas de agente de longa duração

- Persistência de contexto em várias chamadas de ferramenta

O gerenciamento de sessão é tratado no lado do servidor, tornando os agentes de IA mais confiáveis e menos frágeis.

Como o MCP ajuda a reduzir alucinações em sistemas de IA?

O MCP reduz as alucinações ao:

- Impor esquemas estruturados para entradas e saídas

- Fornecer contratos explícitos de ferramentas e dados

- Validar respostas antes de retorná-las ao modelo

- Limitar o acesso a recursos bem definidos

Ao restringir o que o modelo pode ver e fazer, o MCP melhora a fundamentação factual e a confiabilidade da execução.

Quais são os casos de uso comuns para o MCP?

Os casos de uso típicos do MCP incluem:

- Assistentes de codificação de IA

- Chatbots empresariais

- Agentes de IA autônomos

- Pipelines RAG com dados em tempo real

- Ferramentas de desenvolvedor internas

- Sistemas de automação de fluxo de trabalho

Onde quer que a IA precise de acesso seguro e estruturado a sistemas externos, o MCP é aplicável.

O MCP é adequado para sistemas empresariais e de produção?

Sim. O MCP é projetado para implantações de nível de produção.

As características empresariais incluem:

- Autenticação e autorização

- Observabilidade e rastreamento

- Limitação de taxa e cotas

- Escalabilidade horizontal

- Tolerância a falhas

O MCP pode ser implantado localmente para ambientes sensíveis ou remotamente para plataformas em larga escala.

Como o MCP ajuda na escalabilidade e manutenção?

O MCP reduz drasticamente a sobrecarga de integração:

- Um servidor MCP pode atender a muitos clientes de IA

- Novas ferramentas podem ser adicionadas sem alterações no cliente

- As integrações são modulares e componíveis

Isso reduz os custos de manutenção a longo prazo e permite uma iteração mais rápida à medida que os sistemas de IA evoluem.

O MCP está se tornando um padrão da indústria?

O MCP está emergindo rapidamente como o padrão padrão para conectividade entre IA e ferramentas.

Ele já foi adotado por:

- Ambientes de desenvolvimento de IA

- Frameworks de agente

- Assistentes de codificação

À medida que os sistemas de IA se tornam mais agênticos e orientados à ação, protocolos padronizados como o MCP são cada vez mais necessários.

Desenvolvedores e equipes devem aprender o MCP agora?

Sim. Equipes que entendem o MCP cedo obtêm uma vantagem estratégica.

O conhecimento do MCP ajuda a:

- Construir plataformas de IA escaláveis

- Projetar fluxos de trabalho agênticos seguros

- Evitar o bloqueio de fornecedor

- Futuro-provar arquiteturas de IA

À medida que a IA passa da geração para a execução, o MCP se torna uma infraestrutura fundamental.