BlogInsights da indústria

Conectando os Pontos na Pesquisa de IA

Maria ZhuChefe de conteúdo

15 min de leitura

*Este artigo não é uma revisão abrangente de cada relatório, mas uma síntese de sinais recorrentes entre eles.

Quando você lê mais de 10 relatórios importantes sobre IA lado a lado — de gigantes da tecnologia, consultorias e instituições de pesquisa — surgem padrões que nenhuma fonte individual revela por si só. O que encontrei não foram apenas dados sobre taxas de adoção ou ganhos de produtividade. Foi uma história consistente sobre um limiar que já cruzamos: a IA não é mais experimental. O desafio agora é operacional — como escalá-la, governá-la e torná-la durável. Não estou revisando cada relatório individualmente. Em vez disso, estou conectando os pontos — buscando sinais que se repetem em várias fontes e o que eles significam para organizações que tentam escalar a IA além de experimentos.

Os Pioneiros Acertaram

Até o final de 2025, uma coisa havia se tornado óbvia para quem prestava atenção: as equipes que se moveram cedo na IA estavam certas em fazê-lo. Elas não esperaram por estruturas perfeitas ou consenso universal. Elas experimentaram. Elas pilotaram copilotos. Elas testaram agentes e copilotos de IA em fluxos de trabalho reais. Elas aprenderam mais rápido que todos os outros — e isso importa. Se há uma linha divisória clara emergindo à medida que avançamos para 2026, é entre as organizações que trataram a IA como algo a ser observado à distância e aquelas que estavam dispostas a trabalhar com ela enquanto ainda era imperfeita. Estas últimas estão à frente, e deveriam estar.

No último mês, tenho lido relatórios, pesquisas e análises aprofundadas de consultorias, universidades e profissionais. E, juntos, eles contam uma história consistente. A adoção da IA em si não é mais a parte difícil. A parte difícil agora é o que vem a seguir. Não porque a IA seja perigosa ou esteja fora de controle, mas porque, uma vez que ela se incorpora ao trabalho diário, começa a se comportar como qualquer outro sistema crítico: ela precisa de estrutura. Os primeiros a adotar não falharam — eles alcançaram o próximo nível. Eles passaram de “podemos fazer isso?” para “como executamos isso bem, de forma sustentável e segura?”

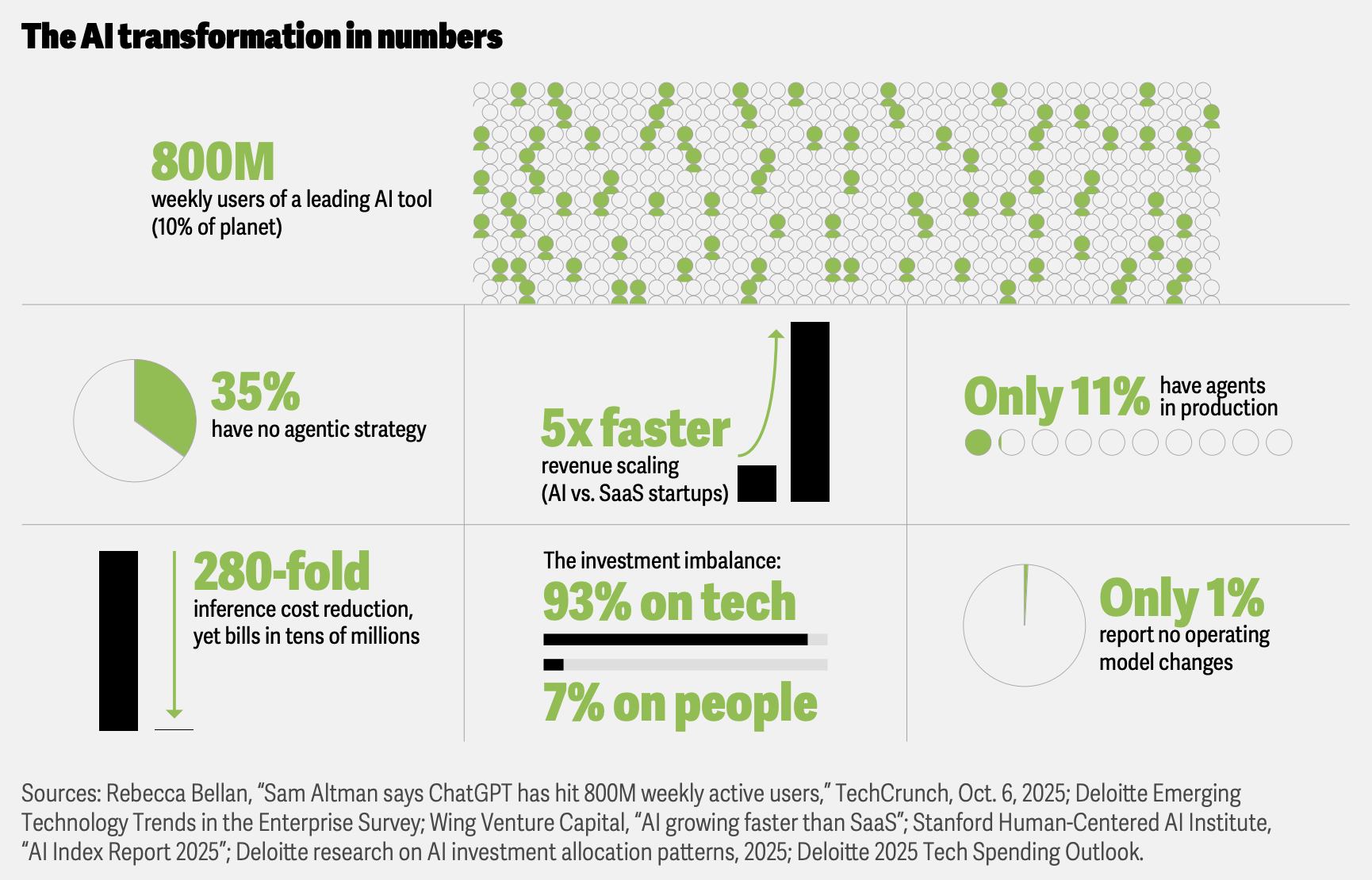

Quando você se afasta e olha para os números, a primeira reação não é entusiasmo. É descrença.

Estima-se que oitocentos milhões de pessoas. Toda semana. Cerca de dez por cento do planeta interage agora com um único sistema de IA (ChatGPT) como parte da vida comum. Esse número por si só deveria ter encerrado o debate sobre se a IA é “precoce” ou “experimental”. Não encerrou. Em vez disso, criou uma estranha ilusão de maturidade — a sensação de que, como a IA está em toda parte, ela já deve estar sob controle. Mas escala não é igual a prontidão. E alcance não é igual a compreensão. As fontes por trás desses números — desde a reportagem do TechCrunch sobre o crescimento do ChatGPT até o Índice de IA de Stanford e as próprias pesquisas empresariais da Deloitte — todas apontam para a mesma verdade incômoda: a adoção superou a estrutura.

O que muitos desses relatórios apontam não é uma crise, mas uma transição. A IA deixou de ser uma iniciativa autônoma e começou a fazer parte da estrutura das organizações — dentro de documentos, fluxos de trabalho, automações e ciclos de decisão. Esse tipo de presença altera as apostas. Quando a inteligência opera na velocidade da máquina e toca dados sensíveis, a segurança não pode ser uma reflexão tardia ou uma função separada que marca caixas mais tarde. Ela precisa existir junto com o próprio trabalho. A Deloitte enfatiza que as considerações de segurança devem ser incorporadas ao design fundamental, em vez de serem adicionadas após a implantação (DI Tech Trends 2026). Isso não é um aviso. É um sinal de maturidade.

Analistas da indústria, incluindo a Wing Venture Capital, observaram que as empresas nativas de IA estão alcançando trajetórias de crescimento significativamente mais rápidas do que as empresas SaaS tradicionais, remodelando fundamentalmente as expectativas dos investidores e a dinâmica competitiva. Esse tipo de aceleração remodela as expectativas da noite para o dia — de investidores, de conselhos, de equipes de liderança que de repente sentem pressão não apenas para adotar a IA, mas para reorganizar tudo em torno dela. E, no entanto, quando a Deloitte pesquisou empresas em seu relatório Tech Trends 2026, o cenário mudou. Apenas onze por cento das organizações têm sistemas de IA agentica em produção, com outros 38% executando pilotos e 35% sem nenhuma estratégia agentica.

Analisando esses relatórios — da Deloitte, Stanford e Anthropic — percebe-se uma mudança encorajadora na narrativa. A IA não é mais enquadrada como algo que precisa ser restringido, mas como algo que precisa ser projetado de forma responsável. Na verdade, muitas organizações já estão usando a IA para fortalecer a segurança — para priorizar riscos, apoiar a conformidade e ajudar as equipes a tomar decisões mais rápidas e bem informadas. A conversa mudou de se a IA pertence às operações centrais para como ela deve ser governada uma vez que esteja lá. Isso é progresso.

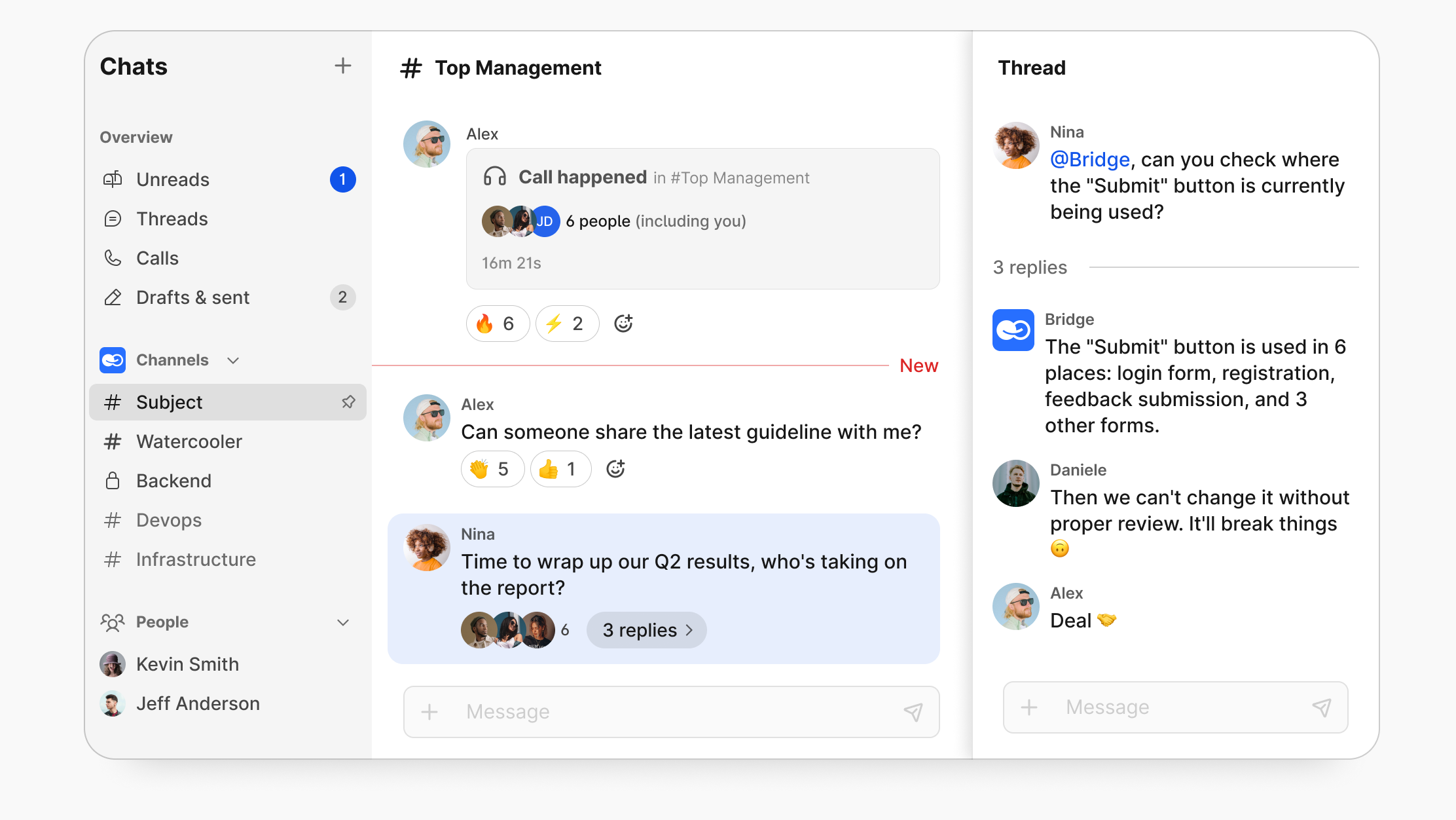

Esta forma de pensar alinha-se de perto com a forma como abordamos o BridgeApp desde o início. Nunca acreditamos que a IA devesse viver num conjunto fragmentado de ferramentas, plugins e serviços desconectados. Colaboração, automação e inteligência funcionam melhor quando existem dentro de um sistema coerente — um que as organizações podem ver, moldar e controlar. É por isso que a implantação local é importante para nós. Não como um ponto de venda, mas como uma resposta prática a uma pergunta real que muitas equipas estão agora a fazer: como escalamos a IA, preservando a segurança, a conformidade e a soberania?

Quando a Confiança se Torna a Nova Superfície de Ataque

Uma das mudanças silenciosas, mas definidoras da era da IA é que a cibersegurança não se trata mais apenas de sistemas, redes ou código. Trata-se de confiança. O Tech Trends 2026 da Deloitte deixa isso claro ao descrever como a IA está remodelando o cenário de ameaças não apenas tecnicamente, mas socialmente — através de deepfakes, identidades sintéticas e engenharia social baseada em IA. Esses não são cenários marginais ou hipotéticos futuros. Eles já fazem parte das operações diárias, desde tentativas de phishing que soam estranhamente humanas até áudios e vídeos falsos que podem se passar de forma convincente por executivos, parceiros ou até mesmo colegas internos. Como a Deloitte observa, a IA está acelerando as ameaças externas, mas tão importante quanto, está mudando como essas ameaças funcionam — explorando velocidade, escala e credibilidade em vez de força bruta (Deloitte Tech Trends 2026, Usando IA em Cibersegurança).

O que é impressionante é que isso não é enquadrado como uma perda de controle, mas como um chamado à clareza. Deepfakes não são bem-sucedidos porque a IA é muito poderosa; eles são bem-sucedidos quando os sistemas carecem de identidade forte, proveniência e governança. A resposta não é desacelerar a adoção da IA, mas elevar o padrão de como a inteligência é implantada, autenticada e supervisionada. A Deloitte enfatiza que as organizações estão se afastando da segurança reativa em direção a salvaguardas integradas em nível de design — construindo visibilidade, controle de acesso e responsabilidade diretamente nos fluxos de trabalho impulsionados por IA. Nesse contexto, a segurança se torna menos sobre bloquear a inovação e mais sobre garantir que a inteligência opere dentro de limites que os humanos realmente entendem e confiam.

É aqui que a arquitetura começa a importar mais do que as ferramentas. As organizações precisam de sistemas onde a IA e a colaboração existam juntas — não espalhadas por plugins e serviços em nuvem. Esse é o pensamento por trás da abordagem de espaço de trabalho unificado da BridgeApp.

É por isso que o BridgeApp foi construído para ser executado on-premise dentro da própria infraestrutura de uma organização — ao contrário do Slack ou Teams — garantindo a soberania dos dados e a conformidade desde o primeiro dia. É também por isso que o BridgeApp é white-label e extensível por design, permitindo que as empresas modelem seus próprios agentes, fluxos de trabalho e modelos de governança, em vez de herdar os padrões de outra pessoa. Em um mundo cada vez mais dominado por um punhado de gigantes de tecnologia dos EUA, essa abordagem oferece algo mais tranquilo, mas mais duradouro: independência digital para organizações europeias, do Oriente Médio e globais que desejam que a IA sirva a seus sistemas — e não os substitua.

À medida que olhamos para 2026, o sinal é calmo, mas inconfundível. Os vencedores não serão as equipes que simplesmente adotaram a IA primeiro — elas já fizeram esse trabalho. Os vencedores serão aqueles que derem o próximo passo: transformar a experimentação em sistemas, a velocidade em estrutura e a inteligência em algo durável. Isso não se trata de desacelerar a inovação. Trata-se de garantir que ela dure.

A Soberania Digital Está se Tornando uma Decisão de Infraestrutura

À medida que as organizações repensam onde sua IA é executada e quão profundamente ela está entrelaçada no trabalho diário, a soberania digital deixa de ser um conceito político e se torna prático. Ela se manifesta não em planos estratégicos, mas em escolhas arquitetônicas — decisões silenciosas sobre controle, jurisdição e independência a longo prazo. Essa perspectiva reflete mudanças mais amplas na infraestrutura destacadas no Deloitte Tech Trends 2026.

- Onde a inteligência reside. Quando a IA processa continuamente conversas, documentos e fluxos de trabalho, a soberania não se trata mais apenas de armazenamento de dados. Trata-se de onde a inferência ocorre, quem controla os modelos em produção e quão visíveis esses sistemas permanecem ao longo do tempo.

- Controle sem atrito. A infraestrutura soberana não significa abrir mão da usabilidade moderna. Significa permitir que as equipes colaborem e automatizem livremente, mantendo as operações sensíveis dentro de ambientes em que confiam e que elas próprias governam.

- Conformidade por design. Para governos, indústrias regulamentadas e empresas globais, a soberania simplifica a conformidade. Quando a IA e as ferramentas de colaboração são executadas on-premise ou em ambientes de nuvem privada, o alinhamento regulatório se torna um padrão arquitetônico, em vez de uma negociação contínua.

- Independência dos monopólios de plataforma. À medida que a IA consolida o poder entre um pequeno número de provedores de nuvem dos EUA, a soberania oferece um caminho alternativo — um em que as organizações não são forçadas a trocar a velocidade da inovação por dependência geopolítica ou operacional.

Esta é a lógica também por trás do BridgeApp. Construído como um espaço de trabalho inteligente para a soberania digital, o BridgeApp reúne comunicação, colaboração e automação impulsionada por IA em uma única plataforma segura que pode ser executada totalmente on-premise ou em uma nuvem privada. Ele oferece a usabilidade que as equipes esperam das ferramentas modernas, ao mesmo tempo em que preserva o controle e a confiança exigidos pelas organizações que escolhem a independência em detrimento da conveniência.

Especialistas do Instituto de IA Centrada no Humano de Stanford preveem que 2026 será o ano em que a soberania passará de slogan a estratégia. Como James Landay, co-diretor do Stanford HAI, colocou: “A soberania da IA ganhará um enorme impulso este ano, à medida que os países tentarem demonstrar sua independência dos provedores de IA e do sistema político dos Estados Unidos. Em um modelo de soberania, um país pode construir seu próprio grande LLM. Em outro exemplo, um país pode executar o LLM de outra pessoa em suas próprias GPUs para garantir que seus dados não saiam de seu país”.

Isso não é geopolítica abstrata. É prático. À medida que a inteligência se entrelaça com os processos de negócios, a questão de onde os dados se movem, onde a inferência é executada e sob quais leis ela vive influencia as decisões de aquisição, as estruturas de conformidade e até mesmo a diferenciação competitiva. Algumas organizações não podem se dar ao luxo de tratar sua infraestrutura de IA como uma caixa preta de terceiros — não por medo, mas porque precisam cumprir leis de proteção de dados, padrões de governança e regulamentações da indústria que simplesmente não acomodam os padrões de nuvem estrangeira. A percepção de Stanford reforça um tema que vem surgindo em vários relatórios: a soberania não é um buzzword, é um imperativo de infraestrutura.

Quando a IA Deixa de Esperar por Prompts

A maior mudança na IA não é o quão fluente ela soa — é o quão independentemente ela se comporta. Ao longo de 2025, os sistemas de IA cruzaram silenciosamente um limiar de ferramentas reativas para atores proativos. A Forbes descreve essa transição como a mudança da IA generativa para a IA agentica, observando que esses sistemas são projetados não apenas para produzir resultados, mas para “agir, raciocinar, colaborar e executar por conta própria” (Chuck Brooks, Forbes, 2025).

Essa mudança altera a forma como o trabalho é feito. A IA agentica não substitui as pessoas — ela muda o papel delas. Em vez de emitir cada instrução, os humanos definem a direção, as restrições e as prioridades, enquanto a IA executa sequências de ações em ferramentas e fluxos de trabalho. O verdadeiro desafio não é a maturidade tecnológica; é a prontidão organizacional. A autonomia força as equipes a esclarecer a propriedade, a responsabilidade e o design — questões que eram mais fáceis de evitar quando a IA apenas respondia.

Dois importantes relatórios de 2025/2026 — “O Estado dos Agentes de IA em 2026” da Anthropic e “Estado da Engenharia de Agentes” da LangChain — mostram que os sistemas agenticos passaram decisivamente de pilotos para a produção, apoiados por dados reais de uso de organizações que já estão implementando agentes em escala:

Mais da metade das organizações (57%) agora implementa agentes para fluxos de trabalho de múltiplas etapas, com 16% executando processos multifuncionais em várias equipes. Em 2026, 81% planejam abordar casos de uso mais complexos, incluindo 39% desenvolvendo agentes para processos de múltiplas etapas e 29% implementando-os para projetos multifuncionais.

A codificação lidera a adoção. Quase 90% das organizações usam IA para auxiliar no desenvolvimento, e 86% implementam agentes para código de produção. As organizações relatam economia de tempo em todo o ciclo de vida do desenvolvimento: planejamento e ideação (58%), geração de código (59%), documentação (59%) e revisão e teste de código (59%).

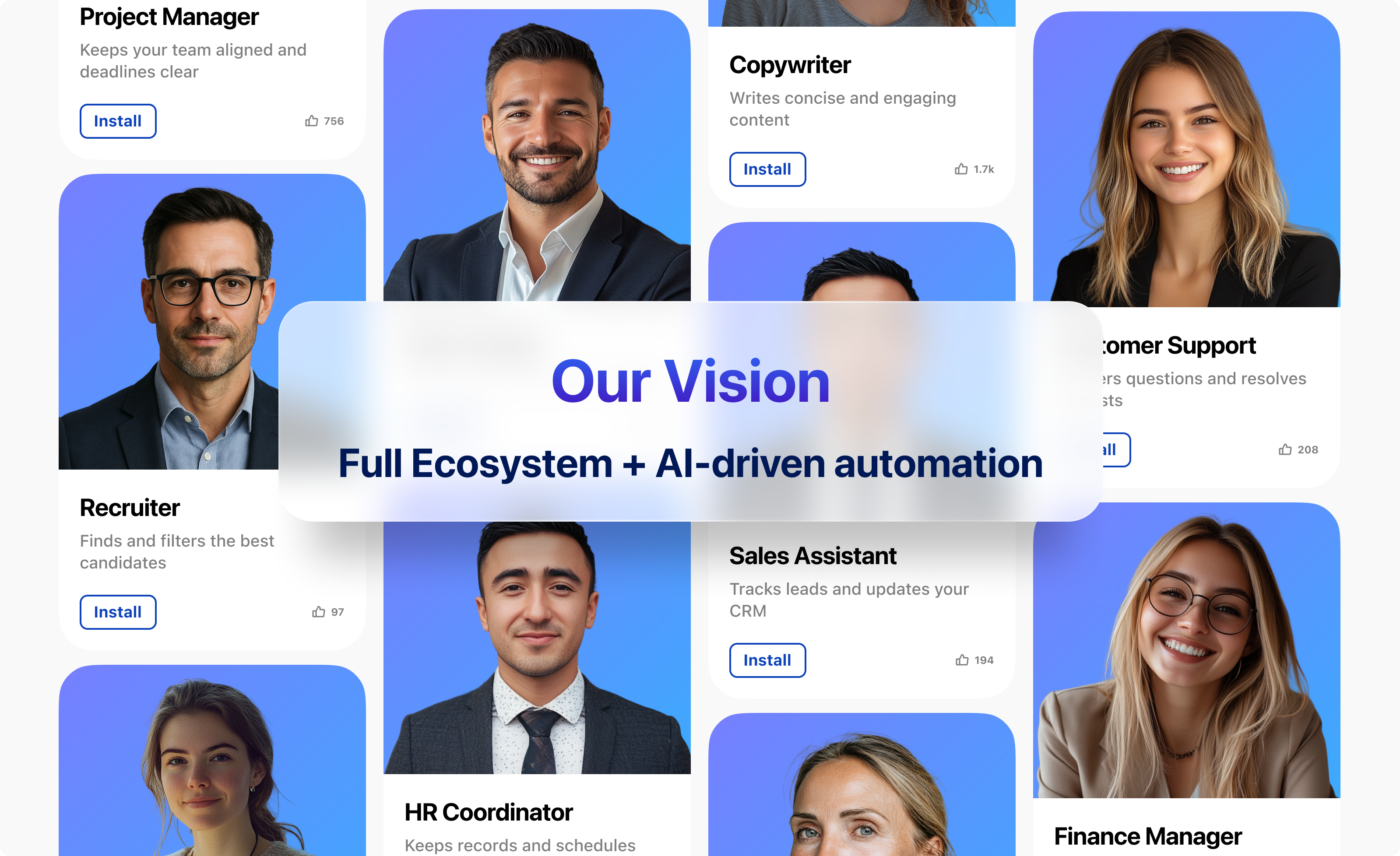

Na BridgeApp, abordamos os agentes de IA como participantes de primeira classe no espaço de trabalho, e não como complementos. Os agentes podem ser totalmente personalizados — não apenas no que fazem, mas em como pensam e se comunicam. Você pode construir assistentes alimentados por IA para amplificar qualquer função, de gerentes de RH a analistas, com conhecimento personalizado, estilo de comunicação e lógica de negócios que refletem os padrões da empresa, em vez de padrões genéricos. Esses agentes evoluem junto com os LLMs de última geração, mas permanecem ancorados no próprio contexto de sua organização.

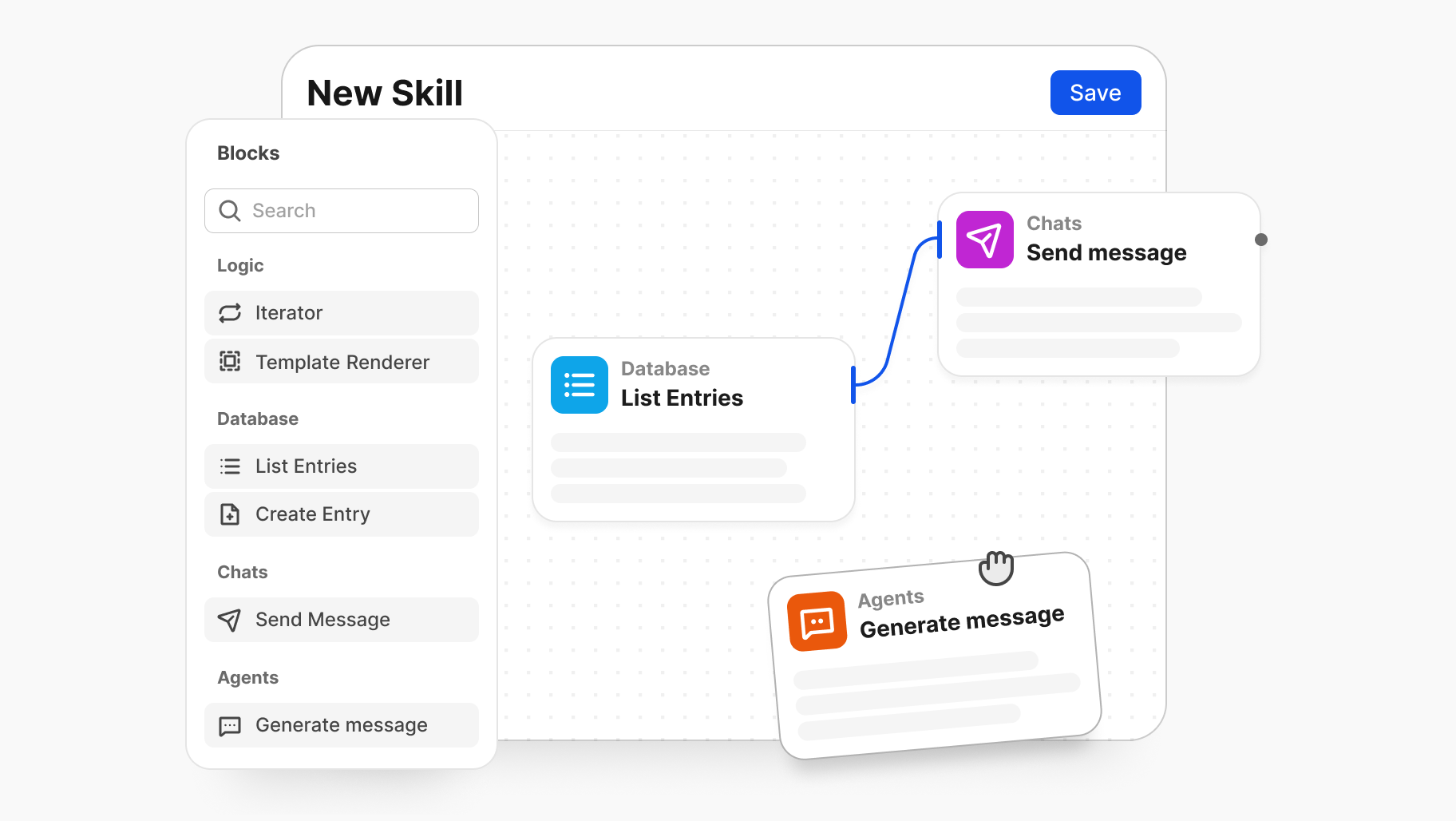

O que dá a esses agentes uma verdadeira alavancagem é o acesso. Os agentes BridgeApp podem trabalhar com todas as entidades dentro do espaço de trabalho — conversas de chat, tarefas, documentos, bancos de dados, dashboards e até mesmo outros agentes de IA. Isso possibilita encadear habilidades em fluxos de trabalho que funcionam de ponta a ponta: um agente que monitora solicitações de entrada, extrai dados relevantes, atualiza registros, aciona acompanhamentos e escala apenas quando o julgamento humano é necessário. E quando uma capacidade específica ainda não existe, isso não se torna um bloqueador. Habilidades personalizadas podem ser construídas para corresponder a processos exatos, em vez de forçar as equipes a adaptar seu trabalho às ferramentas de outra pessoa.

Nesse ponto, a pergunta naturalmente muda de o que os agentes podem fazer para o que eles mudam economicamente. É aqui que o ROI entra na conversa — não como uma promessa, mas como um resultado de direcionar os gargalos certos. Como descrevemos em nosso próprio guia para iniciantes em agentes de IA, os retornos variam amplamente por indústria e qualidade de implantação, mas o padrão é consistente: quando os agentes são aplicados a fluxos de trabalho de alta fricção e uso intensivo de processos, o impacto se acumula rapidamente. Um estudo detalhado publicado em agosto de 2025 demonstrou isso claramente no processamento de hipotecas. Após a introdução de agentes de IA, o ROI mais que dobrou, subindo de 15% para 35%. Os custos operacionais caíram 60%, a produção de empréstimos aumentou na mesma proporção, e o tempo médio de revisão de documentos diminuiu de oito horas para apenas duas — um ganho de eficiência de 75% que se traduziu diretamente em maior capacidade e lucratividade.

A IA Já Está Mudando a Forma Como o Trabalho é Feito

Um dos sinais mais fundamentados no relatório OpenAI State of Enterprise AI 2025 não é sobre modelos ou roteiros. É sobre tempo. Em quase cem empresas, os trabalhadores relatam consistentemente que a IA os está ajudando a produzir trabalho de maior qualidade mais rapidamente — e de maneiras que são tangíveis nas operações diárias, não teóricas. Setenta e cinco por cento dos funcionários pesquisados dizem que o uso da IA melhorou a velocidade ou a qualidade de sua produção. Para os usuários do ChatGPT Enterprise, esse impacto se acumula rapidamente: em média, os trabalhadores relatam economizar entre 40 e 60 minutos por dia ativo, com funções de ciência de dados, engenharia e comunicações economizando ainda mais — muitas vezes de 60 a 80 minutos por dia. Não são ganhos marginais. São o tipo de mudança que altera como um dia de trabalho é sentido.

A percepção mais reveladora vem de onde esses ganhos aparecem. As equipes de contabilidade e finanças relatam as maiores economias de tempo por interação, seguidas de perto por análise, comunicações e engenharia. Isso sugere que a IA não está apenas acelerando tarefas criativas ou exploratórias — ela está remodelando algumas das partes mais estruturadas e orientadas por regras do trabalho empresarial. E quando esses minutos são recuperados em escala, os efeitos se propagam.

De acordo com a mesma pesquisa, 87% dos trabalhadores de TI relatam uma resolução mais rápida de problemas, 85% das equipes de marketing e produtos relatam uma execução mais rápida de campanhas, 75% dos profissionais de RH veem uma melhora no engajamento dos funcionários e 73% dos engenheiros entregam código mais rapidamente. A produtividade é parte da história, mas não toda. O que realmente está mudando é quem faz certos tipos de trabalho e quanto esforço humano ainda é necessário para fazer as coisas avançarem.

Nem Todos Usam a IA da Mesma Forma

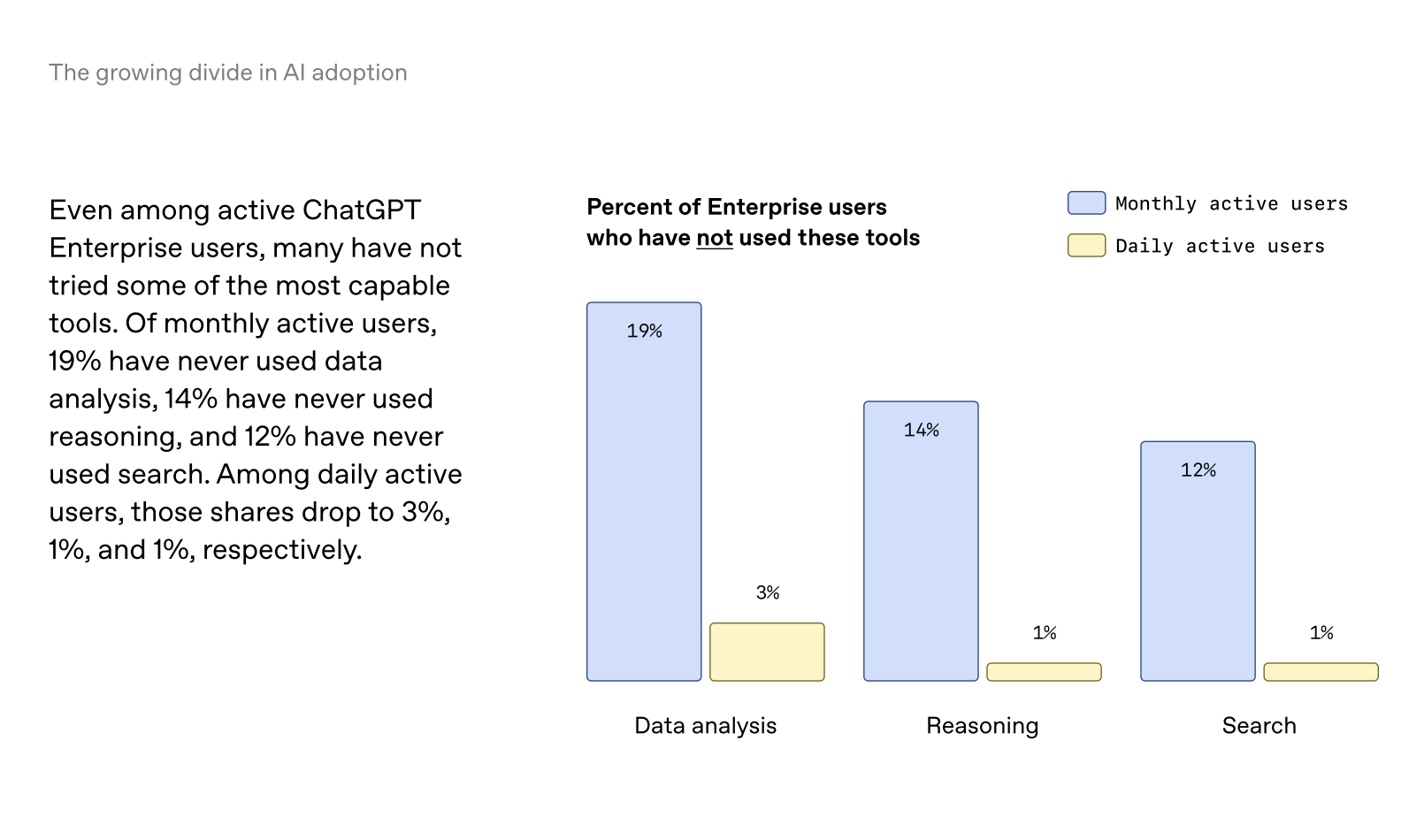

A adoção da IA empresarial é desigual, mesmo entre os primeiros a adotar. Um dos gráficos mais reveladores no relatório OpenAI State of Enterprise AI 2025 mostra uma divisão crescente não entre as empresas que usam IA e as que não usam, mas entre o quão profundamente as pessoas realmente se envolvem com ela. Mesmo entre os usuários ativos do ChatGPT Enterprise, uma parcela significativa nunca tocou em algumas das ferramentas mais capazes. Dezenove por cento dos usuários ativos mensais relatam nunca ter usado a análise de dados. Quatorze por cento nunca usaram o raciocínio. Doze por cento nunca usaram uma pesquisa. Entre os usuários ativos diários, esses números caem drasticamente — para apenas três por cento, um por cento e um por cento, respectivamente.

Essa lacuna fala menos sobre vontade e mais sobre fluência. Pessoas que trabalham com IA todos os dias não apenas fazem mais perguntas — elas exploram mais capacidades. Elas aprendem o que o sistema pode fazer e, como resultado, extraem mais valor dele. Aqueles que se envolvem ocasionalmente tendem a ficar na superfície, usando a IA como uma barra de pesquisa mais rápida ou um assistente de escrita, sem nunca entrar em fluxos de trabalho analíticos ou que exigem raciocínio. O resultado é uma desigualdade silenciosa de resultados. A mesma ferramenta existe em toda a organização, mas os retornos se concentram onde o uso é frequente, contextual e incorporado ao trabalho real.